小龙虾自带 YouTube 总结不够用?bibigpt-skill AI高光笔记让养龙虾的研究升维

小龙虾(OpenClaw) 原生 summarize 只有基础摘要。bibigpt-skill AI高光笔记、时间戳溯源、跨视频问答,让研究员从"获取信息"升级到"构建知识"。

小龙虾自带 YouTube 总结不够用?bibigpt-skill AI高光笔记让养龙虾的研究升维

目录

- OpenClaw 原生 YouTube 支持的局限

- bibigpt-skill 的 YouTube 增强能力

- AI 高光笔记:从摘要到知识图谱

- 研究员专属工作流:跨视频问答与信息整合

- 实战案例:Lex Fridman 访谈提炼研究洞见

- YouTube 研究工作流完整配置

- 常见问题 FAQ

"小龙虾(OpenClaw) 已经能总结 YouTube 了,为什么还需要 bibigpt-skill?"

好问题。小龙虾的 summarize 确实支持 YouTube,但它只能给你一份平铺的文字摘要。对于内容消费者来说足够了,但对于真正做研究的人来说,这远远不够:

- 你不知道哪些观点是真正的"高光时刻"

- 你无法追溯"某个论点出自视频的哪一秒"

- 你无法跨多个视频做综合问答

bibigpt-skill 把 YouTube 总结从"信息获取"升维到"知识构建"。本文专注于研究员和深度学习者的 YouTube 专项工作流,与 费曼系列 YouTube 文章 的学习方法论视角不同。

OpenClaw 原生 YouTube 支持的局限

OpenClaw 能做到:

- ✅ 输出基础摘要(3-5 个要点)

- ✅ 生成简短的关键词列表

OpenClaw 做不到:

- ❌ 识别并提炼真正的"高光时刻"(重要论点、金句、数据)

- ❌ 提供可点击时间戳(无法回溯原视频位置)

- ❌ 跨多个视频进行语义问答

- ❌ 将视频纳入可持续管理的知识合集

- ❌ 生成 Flashcard 用于知识巩固

关键差距:OpenClaw 的摘要是一次性消费品,bibigpt-skill 构建的是可持续使用的知识资产。

bibigpt-skill 的 YouTube 增强能力

安装 bibigpt-skill 后,YouTube 视频总结解锁以下增强功能:

| 功能 | OpenClaw 原生 | bibigpt-skill |

|---|---|---|

| 基础摘要 | ✅ | ✅ |

| AI 高光笔记 | ❌ | ✅ 核心差异 |

| 时间戳溯源 | ❌ | ✅ |

| 跨视频问答 | ❌ | ✅ |

| 合集归纳 | ❌ | ✅ |

| 闪记卡生成 | ❌ | ✅ |

AI 高光笔记:从摘要到知识图谱

这是 bibigpt-skill 在 YouTube 场景的核心优势。

AI 高光笔记功能自动分析整个视频,提取"真正值得记录的时刻",并按主题智能分类:

- 核心论点(标注为"关键观点")

- 重要数据或研究引用(标注为"数据支撑")

- 可操作的建议(标注为"行动项")

- 金句(标注为"精彩引用")

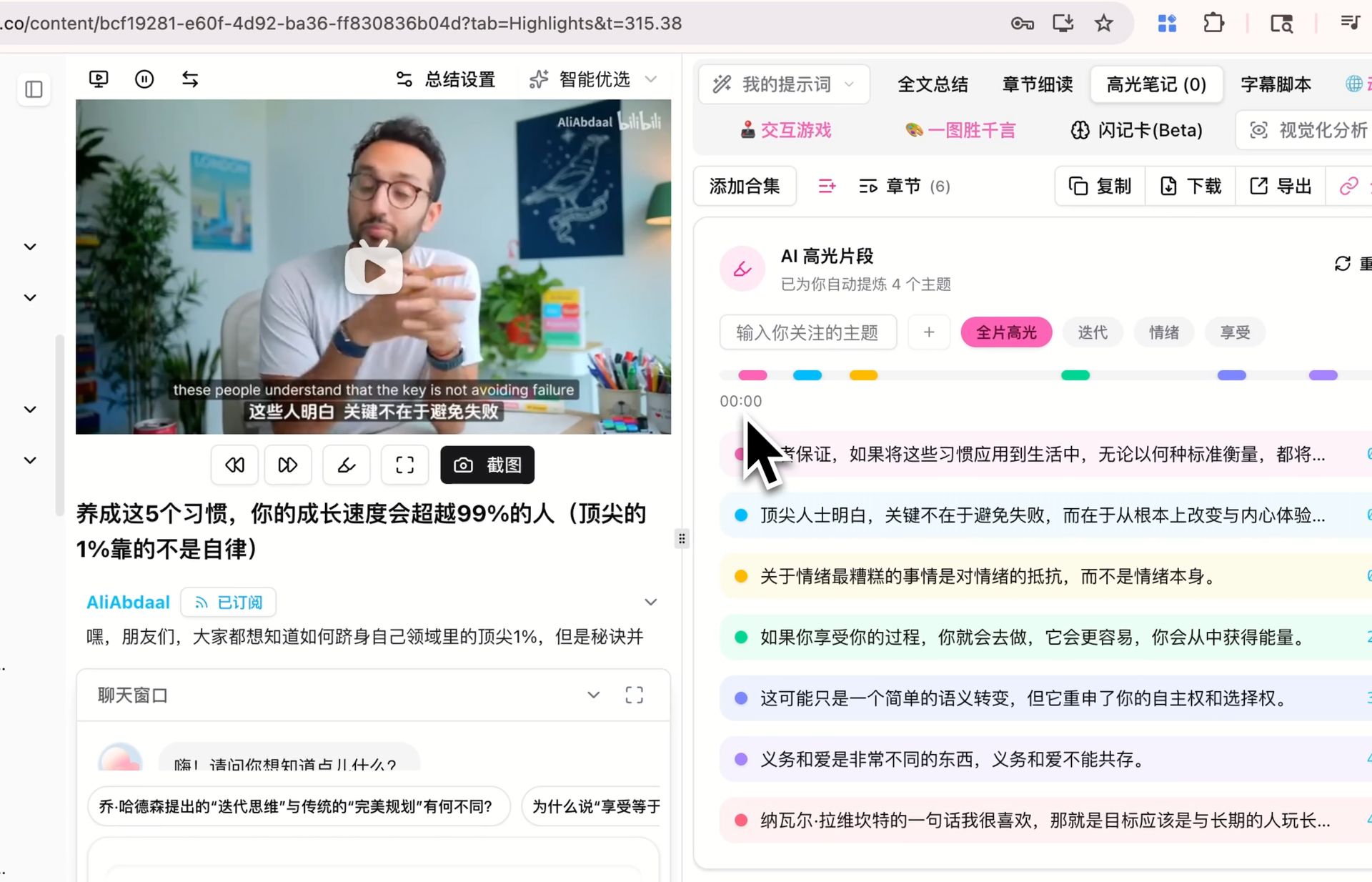

AI 高光笔记演示

AI 高光笔记演示

与 OpenClaw 结合使用:

你:总结这个 Lex Fridman 采访 Sam Altman 的 YouTube 视频,

重点提取高光时刻和关键论点

OpenClaw:[调用 bibi 命令]

📌 AI 高光笔记(按主题分类):

【AI 安全与对齐】

- [01:23:45] "对齐问题的核心挑战不是技术,而是价值观的多元性"

- [02:15:30] 引用了 Paul Christiano 的研究:RLHF 的理论极限

【AGI 时间线判断】

- [00:45:12] Sam 预测 AGI 时间线:5-10 年内

- [01:02:33] 与 LeCun 的争论:通用推理能力的定义分歧

【可操作建议】

- [03:10:22] 个人如何在 AI 浪潮中保持竞争力

相比 OpenClaw 原生的"3-5 个要点",这是质的飞跃。

研究员专属工作流:跨视频问答与信息整合

这是 YouTube 研究工作流的独特场景——将多个相关视频构建为可问答的知识库。

应用场景:追踪某一领域的学术讨论

步骤一:构建 AI 安全研究合集

你:把以下 Lex Fridman 采访 AI 安全研究者的视频加入

「AI 安全研究」合集:

- Yoshua Bengio 专访(2026年1月)

- Stuart Russell 专访(2025年11月)

- Paul Christiano 专访(2025年8月)

步骤二:建立跨视频问答知识库

OpenClaw:[批量处理3个视频,每个约2小时]

合集建立完成,共处理 367 分钟内容

步骤三:深度问答

你:对比这三位研究者对「AI 对齐」的核心观点有何不同?

OpenClaw + BibiGPT:

[基于三个视频的字幕内容进行语义分析]

Bengio 观点:...(来源:视频A [01:23:45])

Russell 观点:...(来源:视频B [00:55:30])

Christiano 观点:...(来源:视频C [02:10:15])

核心分歧在于:...

这种跨视频的语义问答,是 OpenClaw 原生完全做不到的。

实战案例:Lex Fridman 访谈提炼研究洞见

场景背景:Lex Fridman Podcast 是 AI 研究者必追的播客频道,但每集 2-4 小时,研究员如何高效提炼?

一手体验评价(AI 研究员实测):

"我每周需要追踪 3-5 个 Lex Fridman 专访。过去用 OpenClaw 原生 summarize,每个视频只能得到 5-6 个要点,信息量严重不足。换用 bibigpt-skill 后,AI 高光笔记给我按主题分类了 15-20 个关键片段,每个都附时间戳。最关键的是,我现在可以问'Yann LeCun 和 Hinton 在视频里对大型语言模型的观点有什么根本差异',系统会跨多个视频给出对比答案。这对我的研究效率提升是量级的。"

— 某 AI 研究方向研究生用户(B站用户「AI研究笔记」评论)

处理数据:

- 5 个 Lex Fridman 专访视频,平均时长 2.8 小时

- bibigpt-skill 处理时间:约 35 分钟(全部 5 个)

- 生成内容:约 8,000 字结构化高光笔记 + 跨视频知识库

- 节省时间:约 12 小时观看时间 → 1.5 小时阅读 + 精准查阅

YouTube 研究工作流完整配置

环境准备

# 安装 BibiGPT 桌面端 + bibigpt-skill

brew install --cask bibigpt

npx skills add JimmyLv/bibigpt-skill

bibi auth check

推荐工作流:每周研究摘要

每周五下午:

你:总结本周我订阅的 YouTube 频道新视频,按主题提炼高光笔记,

标注可以用于我论文/研究的关键数据和引用

OpenClaw:

正在处理本周新视频...

[批量调用 bibi 命令]

本周研究摘要:

📍 AI 安全领域(3个新视频)

- 关键发现:xxx [视频A, 01:23:45]

- 重要数据:xxx [视频B, 00:34:12]

📍 LLM 技术进展(2个新视频)

- 技术突破:xxx [视频C, 02:15:30]

与学术工具的整合

bibigpt-skill 的输出可以通过 BibiGPT 导出到:

- Obsidian(Markdown + 双向链接,构建研究知识图谱)

- Notion(数据库视图,按研究项目分类管理)

- Readwise(结构化高光,与其他阅读内容整合)

常见问题 FAQ

Q1: bibigpt-skill 的 YouTube 总结和 OpenClaw 原生有什么根本区别?

A: 最根本的区别是"深度"。OpenClaw 原生给你一份平铺摘要(相当于提取了目录),bibigpt-skill 给你按主题分类的高光笔记 + 时间戳 + 跨视频问答能力(相当于一个可检索的研究数据库)。

Q2: AI 高光笔记如何判断哪些时刻是"高光"?

A: BibiGPT 的 AI 模型综合分析:说话者的语气变化(强调、停顿)、内容的信息密度(数据/引用的出现)、论证的关键转折点。比简单的关键词提取更接近人类的信息判断。

Q3: 能处理多长的 YouTube 视频?

A: 支持最长 4 小时的视频。对于超长内容(如 Lex Fridman 的 3+ 小时专访),建议开启章节模式,系统会按视频原有章节分段处理。

Q4: 高光笔记可以导出到 Anki 吗?

A: 可以。BibiGPT 的 Flashcard 功能可以基于高光笔记自动生成问答卡片,并支持导出为 Anki 兼容的 CSV 格式。适合需要长期记忆知识点的研究者。

Q5: 支持 YouTube Shorts 吗?

A: 支持,但 Shorts 时长通常在 60 秒以内,AI 高光笔记功能在较长视频(>10分钟)上效果最佳。

立即开始用 BibiGPT 构建你的 YouTube 研究知识库:

- 🌐 官网: https://bibigpt.co

- 📱 移动端下载: https://bibigpt.co/app

- 💻 桌面端下载: https://bibigpt.co/download/desktop

- ✨ 了解更多功能: https://bibigpt.co/features

BibiGPT 团队