마이크로소프트 자체 음성 베이스: MAI-Voice-1 + MAI-Transcribe-1이 BibiGPT 팟캐스트 요약에 미치는 영향

마이크로소프트가 2026년 MAI-Voice-1(60초 오디오를 1초에 생성)과 MAI-Transcribe-1을 발표했습니다. 이 자체 음성 모델이 AI 팟캐스트 전사와 BibiGPT 사용자에게 어떤 의미일까요? 핵심 차이와 호환 로드맵을 정리합니다.

마이크로소프트 자체 음성 베이스: MAI-Voice-1 + MAI-Transcribe-1이 BibiGPT 팟캐스트 요약에 미치는 영향

목차

- MAI-Transcribe-1이란? AI 팟캐스트 전사에 어떤 영향을 주나요?

- MAI-Voice-1: 60초 오디오를 1초에 생성

- MAI-Transcribe-1 vs Whisper / Voxtral: 세 가지 핵심 차이

- BibiGPT 사용자에게 주는 의미: 더 튼튼한 팟캐스트 요약 토대

- BibiGPT의 호환 및 보완 전략

- 자주 묻는 질문 (FAQ)

- 마무리

MAI-Transcribe-1이란? AI 팟캐스트 전사에 어떤 영향을 주나요?

핵심 답변: MAI-Transcribe-1은 마이크로소프트가 2026년 4월 발표한 자체 ASR(자동 음성 인식) 모델입니다. MAI-Voice-1(TTS)과 함께 발표되었으며, AI 팟캐스트 전사에 미치는 직접적인 영향은 다국어·노이즈 환경에서의 WER(단어 오류율) 감소와 추론 비용 하락입니다. 이는 AI 팟캐스트 요약 같은 하위 앱이 더 정확한 자막 토대를 더 저렴하게 얻을 수 있음을 의미합니다.

Try pasting your video link

Supports YouTube, Bilibili, TikTok, Xiaohongshu and 30+ platforms

2026년 4월 2일, 마이크로소프트 MAI(Microsoft AI) 팀은 두 개의 자체 음성 모델을 동시에 공개했습니다:

- MAI-Voice-1: 음성 합성(TTS). 단일 GPU에서 60초 오디오를 1초에 생성.

- MAI-Transcribe-1: 음성 인식(ASR). 다국어 벤치마크에서 새 SOTA, 추론 지연 대폭 감소.

마이크로소프트가 음성 스택의 양쪽을 자체 모델로 교체한 것은 처음입니다(OpenAI Whisper와 서드파티 TTS 의존에서 탈피). 신호는 분명합니다 — 파운데이션 음성 모델이 "자체 + 엔드투엔드 저지연" 단계로 진입했으며, 팟캐스트·인터뷰·회의 녹음 같은 장시간 오디오가 가장 큰 수혜를 입을 것입니다.

MAI-Voice-1: 60초 오디오를 1초에 생성

핵심 답변: MAI-Voice-1은 마이크로소프트 자체 TTS로, 단일 GPU에서 60초 오디오를 1초에 생성한다고 발표되었습니다. 실시간 음성 어시스턴트, 저지연 더빙, 장문 낭독 등에 적합하며 Copilot Daily / Podcasts에 이미 통합되어 있습니다.

핵심:

- 60× 실시간: 60초 텍스트 → 1초 오디오(단일 GPU), 장문 내레이션에 적합

- 단일 GPU 실행: 클러스터가 필요한 다수 TTS 대비 배포 장벽이 낮음

- 이미 제품 탑재: Copilot Daily News, Podcasts 등에서 사용 중

BibiGPT 같은 "장시간 음영상 요약 → 팟캐스트화" 워크플로에 시사하는 바: 입력측 팟캐스트 전사와 출력측 "2인 대담" 생성 모두 저지연으로 실행 가능. BibiGPT의 팟캐스트 생성은 이미 영상에서 2인 대담 오디오를 생성하며, MAI-Voice-1 같은 고속 TTS의 성숙으로 "요약하면서 내레이션"이 실시간으로 가능해집니다.

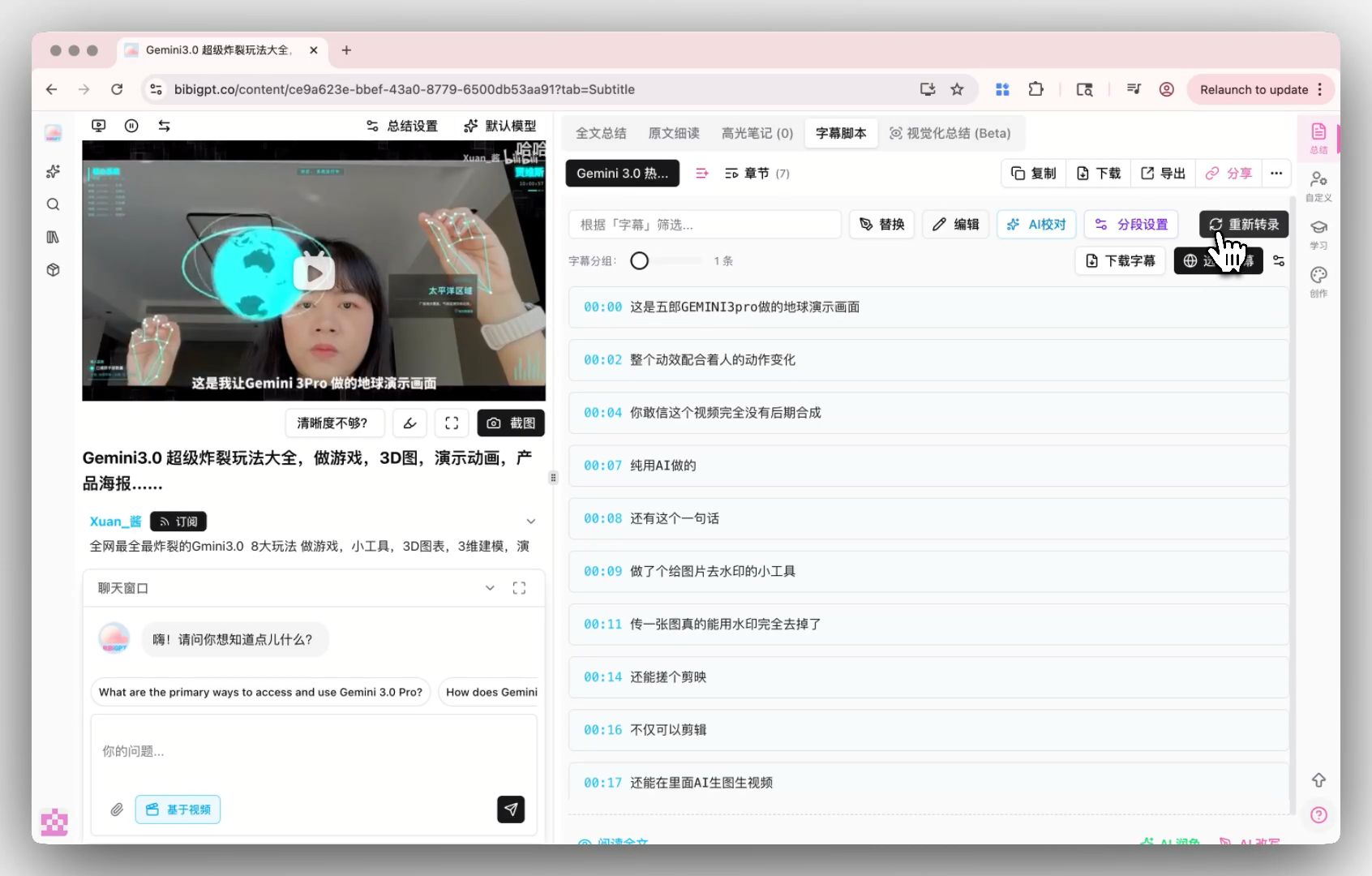

팟캐스트 생성 기능 스크린샷

팟캐스트 생성 기능 스크린샷

MAI-Transcribe-1 vs Whisper / Voxtral: 세 가지 핵심 차이

핵심 답변: OpenAI Whisper-v3, Mistral Voxtral 대비 MAI-Transcribe-1의 주요 차이는 세 가지입니다 — 더 낮은 WER(노이즈·전문 용어), 더 빠른 추론, Azure / Copilot 통합. 단기적으로 Whisper는 오픈소스의 기본값이고, MAI-Transcribe-1은 상용 API의 새 기준점입니다.

| 기준 | MAI-Transcribe-1 | OpenAI Whisper-v3 | Mistral Voxtral |

|---|---|---|---|

| 오픈소스 | 아니오(상용 API) | 예(MIT) | 예(Apache 2.0) |

| 다국어 | 25+, CJK 안정 | 99 언어, 롱테일 약함 | 영·유럽 중심 |

| 장시간 오디오 | 네이티브 60+분 | 분할 필요 | 긴 컨텍스트 |

| 지연 | Whisper 대비 크게 낮음 | 중간 | 빠름 |

| 배포 | Azure 호스팅 중심 | 로컬/클라우드 | 셀프 호스트 |

| 가격 | 분당 과금 | 오픈소스(GPU 직접) | 오픈소스 |

Microsoft AI 공식 블로그에 따르면, MAI 시리즈의 목표는 마이크로소프트의 풀스택 AI(Search, Copilot, Office, Gaming, Bing)의 음성 층을 자체 기술로 통합하는 것입니다. 애플리케이션 레이어 입장에선 더 안정적인 SLA와 명확한 버전 관리를 의미합니다.

"단일 음성 모델에 종속되지 않는" BibiGPT에게 MAI-Transcribe-1은 자체 전사 엔진 풀의 또 다른 선택지이지 교체재는 아닙니다.

자체 전사 엔진: 공급자 선택

자체 전사 엔진: 공급자 선택

BibiGPT 사용자에게 주는 의미: 더 튼튼한 팟캐스트 요약 토대

핵심 답변: BibiGPT 사용자에게 MAI-Transcribe-1 발표는 세 가지 실익을 뜻합니다 — 팟캐스트·장시간 오디오 전사의 정확도 상승, 다국어 자막 번역 워크플로의 부드러움, 자체 전사 엔진 선택지 확장.

케이스 1: 팟캐스트·인터뷰 등 장시간 오디오

30분 이상의 장시간은 Whisper의 약점 — 분할로 문맥이 끊김. MAI-Transcribe-1의 네이티브 긴 컨텍스트 덕에 팟캐스트·업계 인터뷰의 전사 품질이 더 안정적. AI 팟캐스트 요약 워크플로 가이드 참고.

케이스 2: 다국어 콘텐츠 국경간 정리

지역 뉴스, 한·일 인터뷰, 영·중 혼합 회의 — MAI 시리즈는 다국어 혼재 상황에서 WER이 안정적. 콘텐츠 해외 진출·국경간 리서치 사용자에겐 업로드 시 자동 번역의 "인식 → 번역" 체인이 더 정확한 ASR 토대를 얻습니다.

케이스 3: 전문 용어 밀도가 높은 콘텐츠

의학·법률·금융·기술처럼 용어가 밀집된 콘텐츠는 과거 ElevenLabs Scribe 같은 전문 엔진에 의존했습니다. MAI-Transcribe-1 추가로 선택지가 넓어져 콘텐츠 특성에 맞는 토대를 고를 수 있게 됩니다.

BibiGPT의 호환 및 보완 전략

핵심 답변: BibiGPT의 포지셔닝은 한 번도 "단일 음성 모델 종속"이 아니었습니다. MAI-Voice-1 / Transcribe-1의 등장은 BibiGPT의 핵심 플로(전사 → 요약 → 마인드맵 → 글·팟캐스트)가 더 튼튼한 토대 위에서 돌아가게 해줍니다.

호환 경로: MAI-Transcribe-1을 자체 전사 엔진에 탑재

자체 전사 엔진 입구

자체 전사 엔진 입구

BibiGPT의 자체 전사 엔진은 현재 OpenAI Whisper와 업계 최상급 ElevenLabs Scribe를 지원합니다. MAI-Transcribe-1이 Azure / Copilot 내부 사용에 머물지 공개 API가 성숙하는 대로 BibiGPT는 풀에 추가를 검토할 것입니다.

보완 경로: MAI는 토대, BibiGPT는 "지식 산출물" 가공

최상의 ASR이라도 사용자가 받는 건 순수 텍스트일 뿐. BibiGPT의 차별 가치는 자막 산출물의 다음 단계에 있습니다:

- 구조화 요약 + 마인드맵 — 장시간 오디오 지식의 챕터화

- AI 하이라이트 노트 — 타임스탬프 하이라이트 원클릭

- 모음집 요약 — 다회차 팟캐스트 횡단 요약

- 2인 팟캐스트 생성 — 요약을 다시 팟캐스트로, "팟캐스트 입력 → 팟캐스트 출력" 루프 완성

"토대는 교체 가능, 상위 프로덕트는 안정적"인 이 아키텍처가 BibiGPT가 최신 음성 기술을 지속 흡수할 수 있는 열쇠입니다. 더 깊은 배경: Microsoft Copilot vs BibiGPT 영상 요약, MAI-Transcribe-1 vs Cohere 오픈소스 ASR.

AI Subtitle Extraction Preview

Bilibili: GPT-4와 워크플로우 혁명

GPT-4가 업무 방식을 어떻게 혁신하는지 심층 분석한 과학 해설 영상. 모델 내부, 학습 단계, 사회적 변화를 다룹니다.

Want to summarize your own videos?

BibiGPT supports YouTube, Bilibili, TikTok and 30+ platforms with one-click AI summaries

Try BibiGPT Free자주 묻는 질문 (FAQ)

Q1: MAI-Transcribe-1은 오픈소스인가요? 셀프 호스팅 가능한가요?

A: 현재 MAI-Transcribe-1은 오픈소스가 아니며 Azure / Copilot 상용 제품을 통해서만 제공됩니다. 셀프 호스팅이 필요하면 OpenAI Whisper(MIT) 또는 Mistral Voxtral(Apache 2.0)을 계속 사용하세요.

Q2: BibiGPT는 기본적으로 MAI-Transcribe-1을 쓰나요?

A: 아직 아닙니다. BibiGPT는 자체 + Whisper 하이브리드를 기본으로 사용하며, 자체 전사 엔진에서 ElevenLabs Scribe로 전환 가능합니다. MAI-Transcribe-1 공개 API 성숙 후 평가 예정.

Q3: MAI-Voice-1이 팟캐스트 크리에이터에게 주는 직접적 이익은?

A: 크리에이터는 향후 MAI-Voice-1 같은 고속 TTS로 원고를 다수 진행자 오디오로 역변환할 수 있습니다. BibiGPT의 팟캐스트 생성은 이미 영상에서 2인 대담을 생성하며, TTS 발전으로 지연이 더 낮아집니다.

Q4: 한국어 팟캐스트에서 MAI-Transcribe-1은 Whisper보다 얼마나 더 나은가요?

A: 현재 한국어 공개 벤치마크는 제한적. BibiGPT에서 Whisper와 ElevenLabs Scribe를 나란히 실행해 비교해 보시고, MAI-Transcribe-1 공개 후 BibiGPT가 실측 비교를 게시할 예정.

Q5: 왜 모든 전사를 최강 모델로 기본 전환하지 않나요?

A: 모델마다 비용·정확도·언어 지원의 트레이드오프가 다릅니다. 단일 모델에 하드 바인딩하면 극단적 상황(희소 언어, 전문 용어)에서 사용자 선택권이 사라집니다. BibiGPT의 자체 전사 엔진은 이 선택을 사용자에게 되돌려줍니다.

마무리

마이크로소프트 MAI-Voice-1 + MAI-Transcribe-1의 발표는 파운데이션 음성 모델이 "자체 + 엔드투엔드 저지연" 단계로 진입했음을 뜻합니다. AI 음영상 도구엔 토대 능력의 총체적 업그레이드 — 더 정확한 전사, 더 빠른 합성, 더 튼튼한 장시간 오디오.

BibiGPT의 제품 철학은 한 번도 특정 모델 종속이 아니라, 어떤 강력한 토대도 사용자가 볼 수 있는 지식 산출물로 매끄럽게 전환하는 것이었습니다. MAI 시리즈 성숙 시 BibiGPT는 즉시 자체 전사 엔진 풀에 추가해, 한국어 팟캐스트·국경간 영상·장시간 오디오 학습 시나리오에 가장 안정적인 AI 요약 경험을 이어갈 것입니다.

지금 AI 효율적인 학습 여정을 시작하세요:

- 🌐 공식 웹사이트: https://aitodo.co

- 📱 모바일 다운로드: https://aitodo.co/app

- 💻 데스크톱 다운로드: https://aitodo.co/download/desktop

- ✨ 더 많은 기능 알아보기: https://aitodo.co/features

BibiGPT 팀