OpenAI Realtime API 正式 GA:MCP 工具调用 + 幻觉骤降 90%,BibiGPT 如何补全音视频最后一公里

OpenAI gpt-realtime API 于2025年8月28日正式 GA,支持 MCP 远程服务器、图片输入和 SIP 电话集成。本文深度解析三大新能力、定价变化及转录幻觉降低90%的技术突破,以及 BibiGPT 作为 MCP 工具如何帮助普通用户30秒总结30+平台音视频内容。

OpenAI Realtime API 正式 GA:MCP 工具调用 + 幻觉骤降 90%,BibiGPT 如何补全音视频最后一公里

OpenAI gpt-realtime API 已于 2025 年 8 月 28 日正式 GA(General Availability),这是一个语音到语音(speech-to-speech)模型,新增三大能力:远程 MCP 服务器支持、图片输入和 SIP 电话集成,并新增 Cedar 和 Marin 两个语音。同时,配套转录模型的幻觉率相比 Whisper v2 降低约 90%。但对大多数中文用户来说,Realtime API 仍是开发者工具,门槛高、价格贵、中文平台覆盖为零。 BibiGPT 作为已服务 100 万+用户的全平台 AI 音视频助理,正是连接前沿语音 AI 与日常音视频消费的「最后一公里」。

OpenAI Realtime API 三大突破:MCP、图片输入、SIP 电话

试试粘贴你的视频链接

支持 YouTube、B站、抖音、小红书等 30+ 平台

2025 年 8 月 28 日,OpenAI 宣布 gpt-realtime API 正式从 beta 转为 GA(beta 版本将于 2026 年 5 月 7 日弃用)。作为 speech-to-speech 模型,它的核心定位是让 AI 能够「听」和「说」——不再需要先转文字再理解。以下是三项关键新能力:

1. 远程 MCP 服务器支持

Realtime API 现在原生支持调用远程 MCP(Model Context Protocol)服务器。这意味着语音 Agent 可以在对话中实时调用外部工具——查数据库、操作 API、获取实时信息——实现真正的「边说边做」。对开发者而言,这是构建复杂语音工作流的基础设施级更新。

2. 图片输入(Image Input)

gpt-realtime 现在支持多模态输入,用户可以在语音对话中发送图片,模型能结合视觉和语音上下文进行理解和回应。这为语音助手增加了「看」的能力。

3. SIP 电话集成

通过与 Twilio 和 Voximplant 的集成,Realtime API 可以直接接入传统电话网络。企业可以快速搭建 AI 电话客服、自动外呼系统,无需额外的语音网关。

性能提升同样显著: S2S 模型在基准测试中提升了 26-48%(BigBench Audio 82.8%、MultChallenge 30.5%、ComplexFuncBench 66.5%)。

定价与转录幻觉:开发者需要知道的数字

核心答案: GA 版本比 preview 便宜 20%,音频输入 $32/百万 token、输出 $64/百万 token,缓存输入仅 $0.40/百万 token(节省 98.75%)。Mini 模型更低至 $10/$20。配套转录模型幻觉率比 Whisper v2 降低约 90%。

具体定价结构:

| 模型 | 音频输入 | 音频输出 | 缓存输入 |

|---|---|---|---|

| gpt-realtime | $32/1M tokens | $64/1M tokens | $0.40/1M tokens |

| gpt-realtime-mini | $10/1M tokens | $20/1M tokens | 更低 |

比 preview 版本便宜 20%,缓存输入的 98.75% 折扣对高频调用场景极具吸引力。

在转录质量方面,OpenAI 的新转录模型相比 Whisper v2 的幻觉率降低了约 90%。这对依赖转录准确性的应用(字幕生成、会议记录、播客转文字)是一个重大利好。

但需要注意:这仍然是开发者 API 的定价。普通用户无法直接使用 Realtime API,需要通过开发者构建的应用间接体验。这正是下一节要讨论的问题。

对普通用户意味着什么?三个现实差距

Realtime API 确实强大,但对中文音视频消费者来说,存在三个现实差距:

- 开发者工具,不是消费者产品。 你需要写代码才能使用 Realtime API,它没有 UI、没有"粘贴链接就能用"的体验。

- 价格不便宜。 即使 GA 后降价 20%,音频输出 $64/百万 token 对个人用户仍然昂贵。处理一段 30 分钟的播客可能花费数美元。

- 中文平台覆盖为零。 Realtime API 本身不会帮你总结 B 站视频、小红书笔记或抖音短视频——它不知道这些平台的存在。

这并不是批评 Realtime API,它的定位本就是开发者基础设施。但这恰好说明了为什么你需要一个面向消费者的「翻译层」——把底层 AI 能力转化为粘贴链接即可使用的产品体验。

想了解 AI 如何为不同平台的视频提供总结?推荐阅读:YouTube AI 总结指南、B 站 AI 总结、播客 AI 总结。

BibiGPT 如何补全最后一公里:从 API 到一键总结

看看 BibiGPT 的 AI 总结效果

B站:【渐构】万字科普GPT4为何会颠覆现有工作流

了解GPT4如何改变工作方式的深度科普视频

核心答案: BibiGPT 覆盖 30+ 音视频平台、已生成 500 万+ AI 总结,是连接前沿语音 AI 能力与日常音视频消费的消费者产品。通过 bibigpt-skill(MCP 工具),语音 Agent 也可以直接调用 BibiGPT 获取视频理解能力。

BibiGPT 的价值在于三层补全:

第一层:全平台覆盖

Realtime API 不认识 B 站、小红书、抖音。BibiGPT 覆盖 30+ 平台——YouTube、B 站、小红书、抖音、播客(小宇宙/Apple Podcasts)、本地文件——粘贴链接即可获得 AI 总结。无需写一行代码。

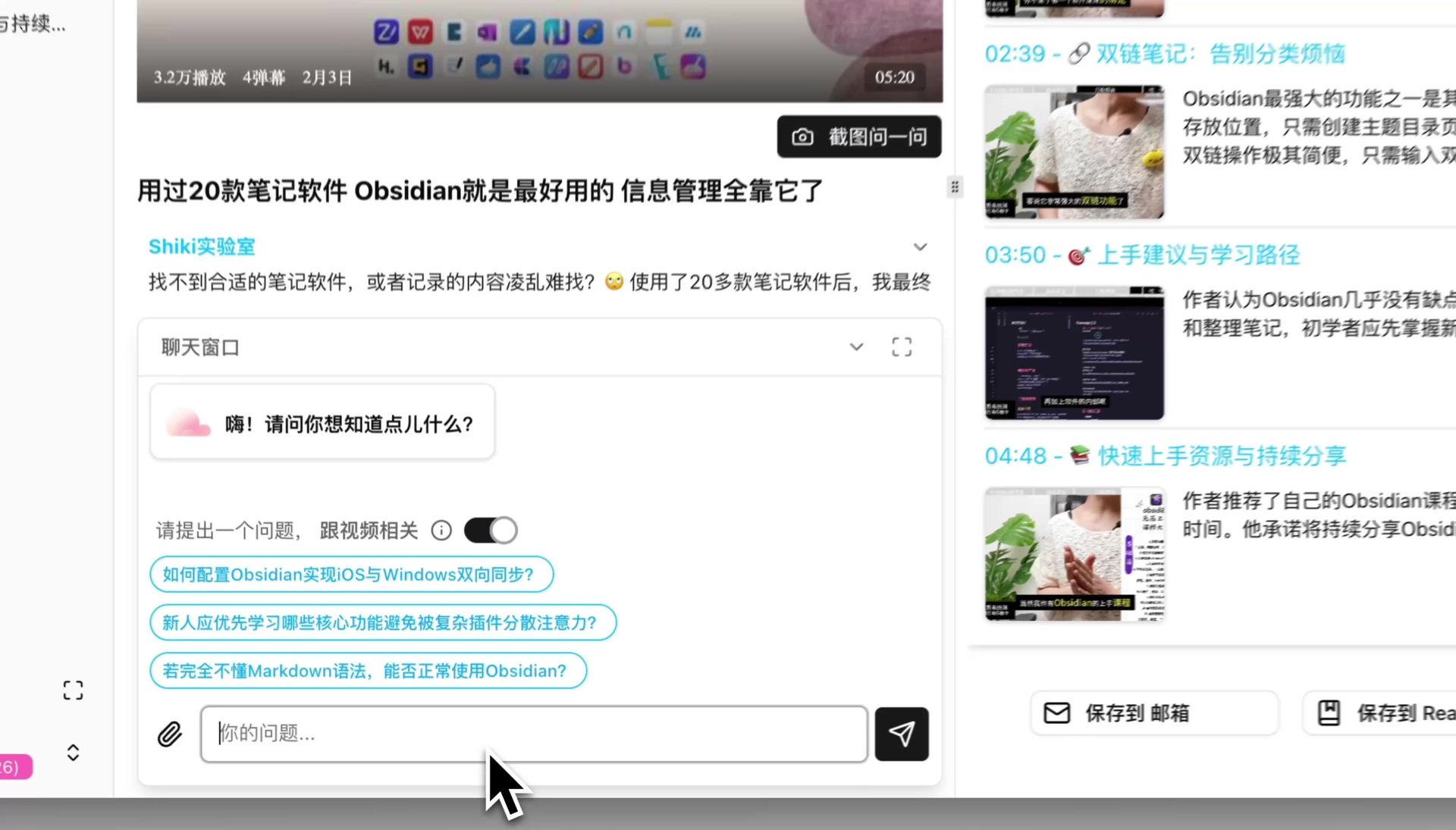

第二层:消费者级体验

从粘贴链接到获得结构化总结,全程 30 秒。支持思维导图、AI 对话追问(带时间戳溯源)、闪记卡导出 Anki、字幕翻译等进阶功能。100 万+用户验证的产品体验。

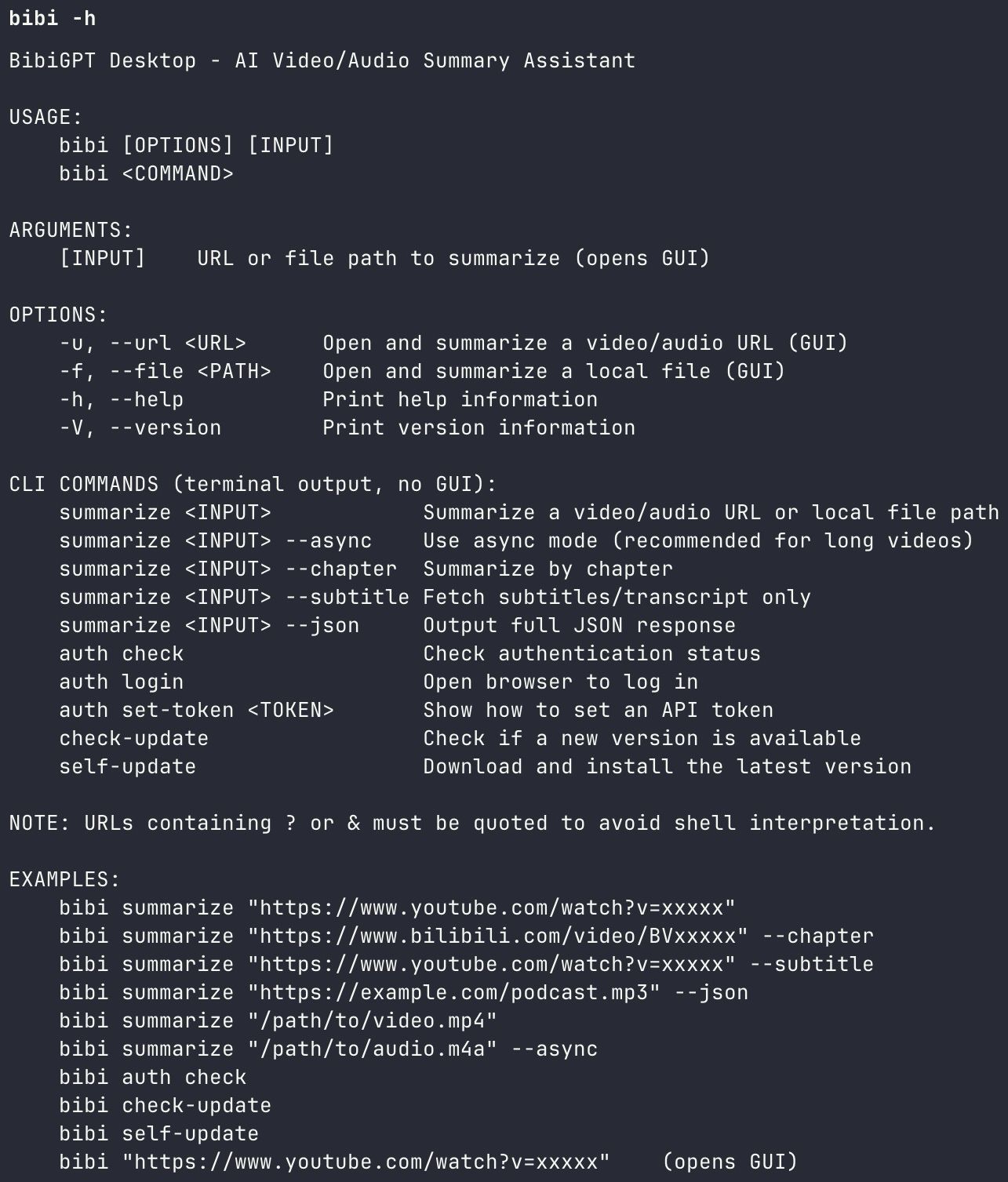

第三层:bibigpt-skill 作为 MCP 工具

这才是与 Realtime API + MCP 最直接的关联:BibiGPT 本身就是一个 MCP 工具。 当你的语音 Agent 接入了 Realtime API 的 MCP 能力后,它可以通过 bibigpt-skill 调用 BibiGPT 的视频总结能力:

- 语音 Agent 说:「帮我总结这个 YouTube 视频」

- Agent 通过 MCP 调用 bibigpt-skill

- BibiGPT 返回结构化总结

- Agent 用语音把总结念给你

BibiGPT Agent Skill CLI

BibiGPT Agent Skill CLI

这意味着 Realtime API 的语音能力和 BibiGPT 的视频理解能力可以无缝组合——前者负责「听和说」,后者负责「看视频」。想了解更多 Agent Skill 的实际用法,参阅 Claude Code + BibiGPT Agent Skill 实战指南。

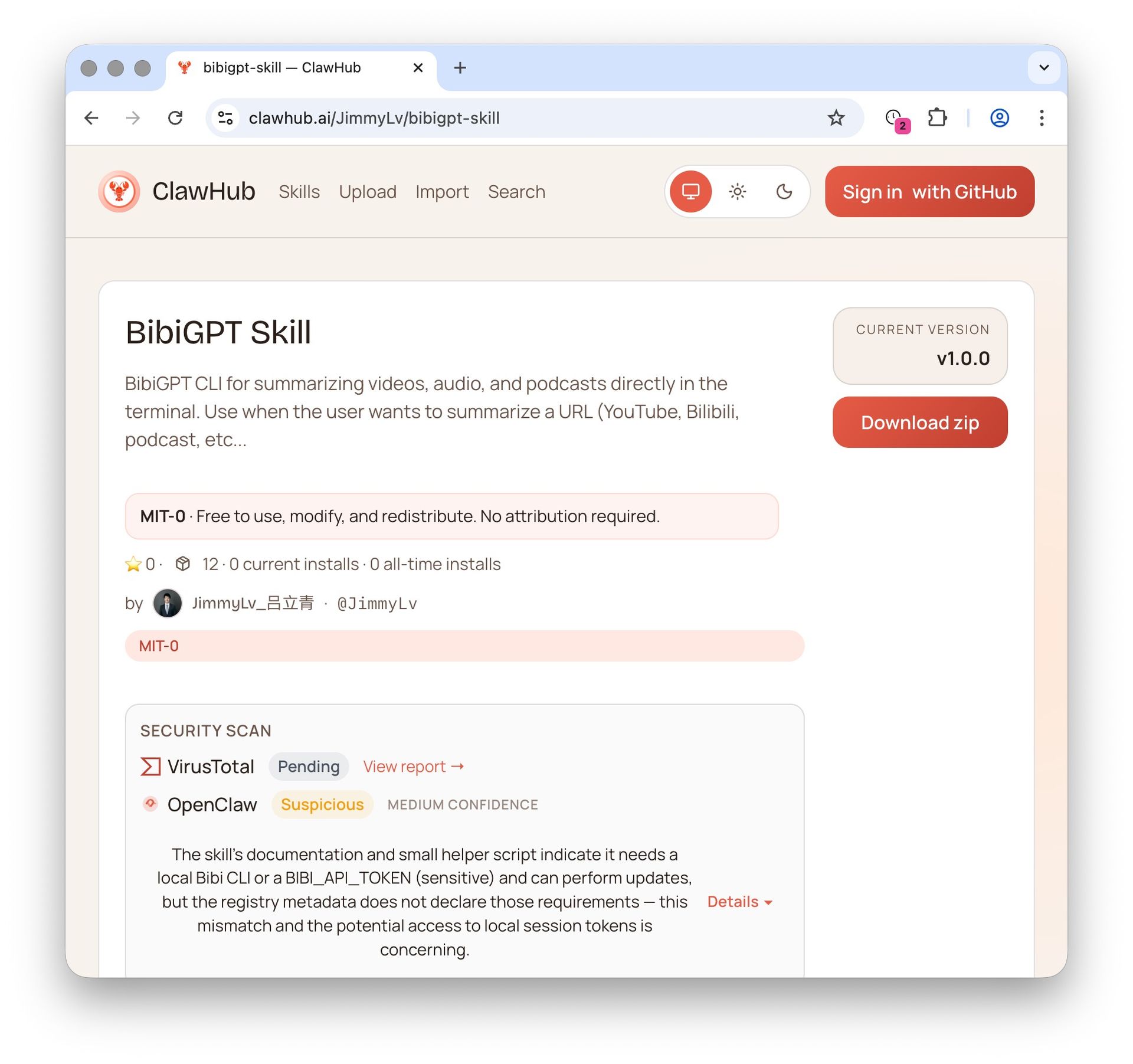

BibiGPT on ClawHub

BibiGPT on ClawHub

实战场景:Realtime API + BibiGPT 的组合打法

以下是三个典型的组合使用场景:

场景一:语音驱动的视频学习

你在开车时对语音助手说:「总结我收藏夹里最新的三个 B 站 AI 教程视频」。语音 Agent 通过 MCP 调用 bibigpt-skill 批量处理,然后用语音播报每个视频的核心要点。从收藏到消化,无需看屏幕。

场景二:会议录音 + 视频参考材料一站式处理

Realtime API 的转录能力(幻觉降低 90%)用于会议录音转文字,bibigpt-skill 同时处理会议中提到的参考视频链接,最终生成一份包含会议纪要和视频摘要的结构化报告。

场景三:播客创作者的效率工具

播客主持人用 SIP 电话集成录制远程访谈,Realtime API 实时转录,然后通过 BibiGPT 的 播客 AI 总结功能自动生成节目摘要和时间轴。过去需要 2 小时的后期工作,现在缩短到 10 分钟。

想了解 BibiGPT 在 OpenClaw 等平台上的 Agent 工作流?推荐阅读 OpenClaw + BibiGPT Agent Skill 实战指南。

BibiGPT AI对话

BibiGPT AI对话

常见问题解答(FAQ)

OpenAI Realtime API 和普通的 ChatGPT 语音有什么区别?

Realtime API 是开发者用来构建语音应用的底层 API,属于 speech-to-speech 模型。ChatGPT 的语音功能是基于这类技术构建的消费者产品。两者的关系类似于「引擎」和「汽车」——你不能直接开引擎上路。

BibiGPT 会使用 Realtime API 吗?

BibiGPT 持续跟进最新的 AI 模型能力。Realtime API 的转录质量提升(幻觉降低 90%)和 MCP 工具调用能力都可能被整合到 BibiGPT 的技术栈中,以进一步提升总结准确性和 Agent 协作能力。

bibigpt-skill 作为 MCP 工具需要额外付费吗?

bibigpt-skill 对 BibiGPT 订阅用户(Plus/Pro)开放,Agent Skill 每日 100 次调用是会员权益。无需额外购买 MCP 相关费用。

Realtime API 的 beta 版什么时候停用?

OpenAI 计划于 2026 年 5 月 7 日弃用 beta 版本。正在使用 beta API 的开发者应尽快迁移到 GA 版本。

BibiGPT 支持哪些平台的音视频总结?

BibiGPT 支持 30+ 平台,包括 YouTube、B 站、小红书、抖音、播客(小宇宙/Apple Podcasts/Spotify)、Twitter/X 视频、本地音视频文件等。更多详情参阅 BibiGPT AI 音视频总结工具介绍。

结语

OpenAI Realtime API 的 GA 发布将语音 AI 的开发者体验推向新高度——MCP 工具调用、多模态输入、SIP 集成,每一项都在扩展语音 Agent 的能力边界。但对于绝大多数需要快速消化音视频内容的用户来说,你需要的不是 API,而是一个粘贴链接就能用的产品。BibiGPT 覆盖 30+ 平台、500 万+总结、MCP 工具调用能力,正是那个把前沿 AI 能力转化为日常生产力的桥梁。

立即体验 BibiGPT,开启你的 AI 音视频高效学习之旅:

- 官网: https://bibigpt.co

- 移动端下载: https://bibigpt.co/app

- 桌面端下载: https://bibigpt.co/download/desktop

- 了解更多功能: https://bibigpt.co/features

BibiGPT 团队