OpenClaw(오픈클로) 25만 스타 OpenAI 인수: AI 에이전트 시대, BibiGPT 영상 요약으로 학습을 자동화하세요

오픈클로(OpenClaw)가 60일만에 깃허브 역대 최고 성장 기록을 깨고 OpenAI에 인수됐습니다. AI 에이전트 시대, BibiGPT와 bibigpt-skill로 영상 학습 파이프라인을 5단계로 완성하세요.

OpenClaw(오픈클로) 25만 스타 OpenAI 인수: AI 에이전트 시대, BibiGPT 영상 요약으로 학습을 자동화하세요

2026년 2월, AI 업계를 뒤흔든 사건이 있었습니다.

Peter Steinberger가 개발한 오픈소스 AI 에이전트 프레임워크 **OpenClaw(오픈클로)**가 단 60일 만에 GitHub 스타 25만 개를 돌파하며, React가 10년 동안 쌓아온 기록을 단숨에 깨버렸습니다.

그리고 OpenAI는 즉시 행동에 나섰습니다. Steinberger를 영입해 "AI 에이전트를 모두에게 가져다주는" 작업에 합류시켰죠.

이것은 단순한 기술 뉴스가 아닙니다. AI 에이전트가 개발자 장난감에서 대중 인프라로 전환되는 역사적 순간입니다.

영상 콘텐츠로 매일 공부하는 지식 근로자에게, 이 변화는 무엇을 의미할까요? 이제 당신의 AI 어시스턴트가 진짜로 "영상을 보고, 정보를 추출하고, 지식 베이스를 만들어주는" 시대가 왔다는 뜻입니다. BibiGPT가 바로 그 핵심 도구입니다.

오픈클로 폭발적 성장의 의미: 대화 AI에서 행동 AI로

오픈클로는 하나의 근본적인 능력을 제공합니다: AI 모델이 단순히 질문에 답하는 대신, 컴퓨터를 직접 조작해 실제 작업을 수행하게 하는 것.

- 이메일 자동 확인·답장·분류

- 브라우저 자동 조작으로 양식 작성, 예약, 쇼핑

- 30분마다 자동 실행되는 심박(heartbeat) 예약 작업

- Slack, WhatsApp을 통한 원격 Mac 조종

커뮤니티가 제공하는 3,500개 이상의 스킬로 ClickUp, GitHub, Figma, 스마트홈과 연동됩니다.

OpenAI가 창시자를 영입한 것은 단순한 인재 채용이 아닙니다. AI 에이전트가 차세대 컴퓨팅 패러다임임을 선언한 것입니다.

AI 에이전트가 아직 보지 못하는 것: 영상

텍스트, 코드, API — AI 에이전트는 이것들을 잘 처리합니다. 하지만 영상은 여전히 고립된 섬입니다.

유튜브에는 매분 500시간 분량의 영상이 업로드됩니다. Bilibili에는 매일 수백만 개의 콘텐츠가 올라옵니다. 이 풍부한 지식 자원 대부분이 AI 에이전트의 손길이 닿지 않는 곳에 존재합니다.

오픈클로의 기본 summarize 스킬은 유튜브만 처리할 수 있습니다. Bilibili, 小红书(샤오홍슈), 抖音(더우인), 팟캐스트는 지원하지 않죠.

바로 여기서 bibigpt-skill이 필요합니다.

bibigpt-skill: AI 에이전트에 영상 이해 능력 장착하기

bibigpt-skill은 BibiGPT의 완전한 영상 처리 파이프라인을 표준 CLI로 노출시켜, OpenClaw / Claude Code 같은 AI 에이전트가 직접 호출할 수 있게 해줍니다.

# Claude Code 환경에서 bibigpt-skill 설치

npx skills add JimmyLv/bibigpt-skill

# 그 다음 에이전트에게:

# "이 B站 영상 요약해줘, 핵심 주장 3가지 추출해줘"

# 에이전트가 자동으로 bibi summarize 호출

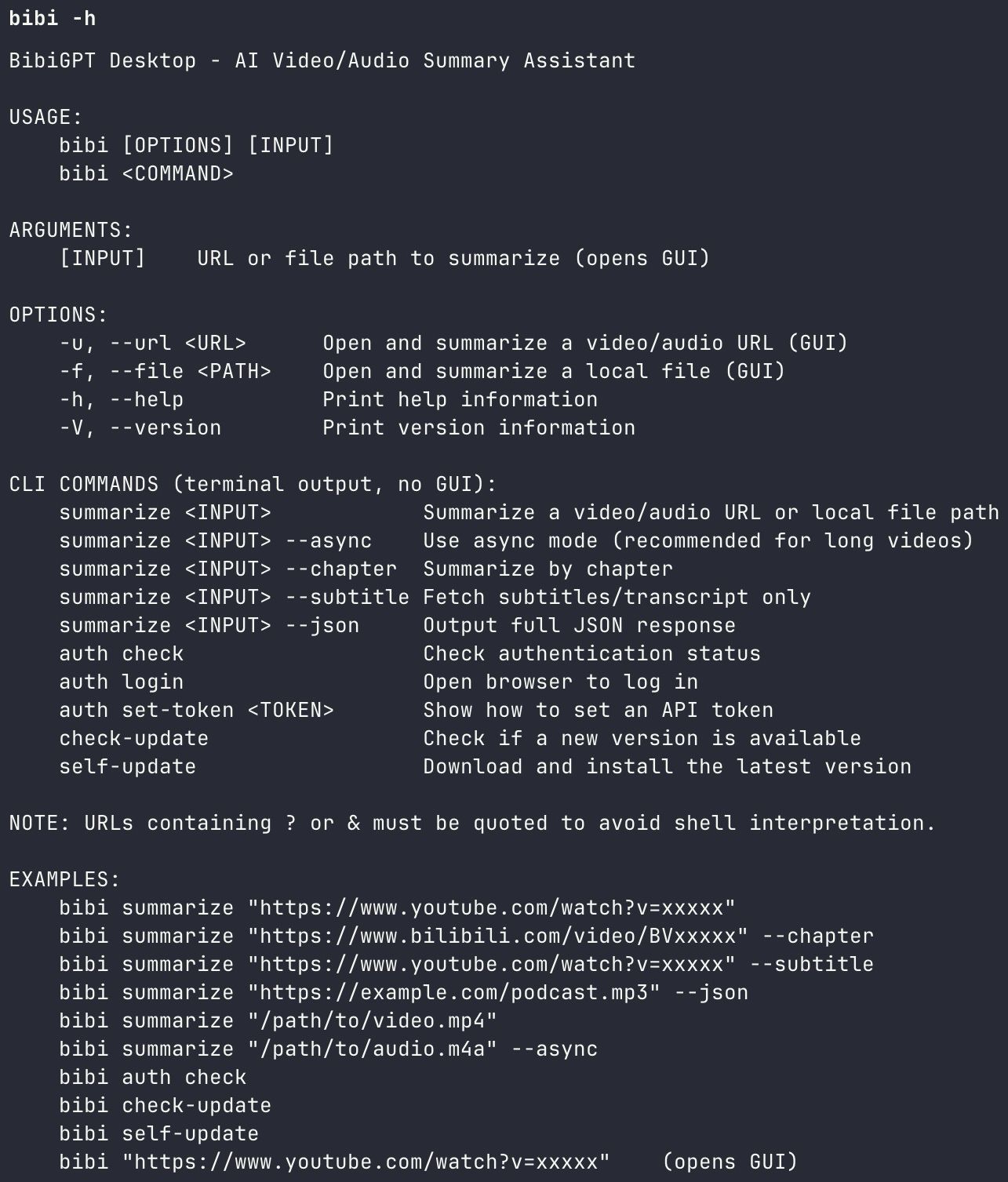

BibiGPT CLI와 bibigpt-skill 설치 화면

BibiGPT CLI와 bibigpt-skill 설치 화면

자세한 비교 가이드는 OpenClaw + BibiGPT Skill: Bilibili·小红书 영상 요약 완전 지원를 참고하세요.

AI 에이전트 시대 영상 학습 5단계 파이프라인

BibiGPT + OpenClaw(또는 Claude Code)를 활용한 개인 영상 학습 자동화 시스템입니다.

1단계: 자동 수집 — 에이전트가 정보원을 순찰하게

매일 오전 8시 실행되는 OpenClaw 심박 작업을 설정합니다:

1. 구독 중인 YouTube 채널 + Bilibili 크리에이터의 신규 영상 목록 수집

2. 각 영상에: bibi summarize "<url>" --chapter --json 실행

3. Markdown 일보 생성 → Slack / 이메일로 전송

2단계: 구조화 요약 — 흐름이 아닌 지식 블록

bibi summarize --chapter 모드는 영상을 챕터 단위의 지식 블록으로 분해합니다:

- 핵심 주장(1~3문장)

- 핵심 데이터 포인트

- 타임스탬프 앵커

인지과학 연구에 따르면 구조화된 요약은 선형 읽기 대비 정보 보유율을 약 40% 향상시킵니다.

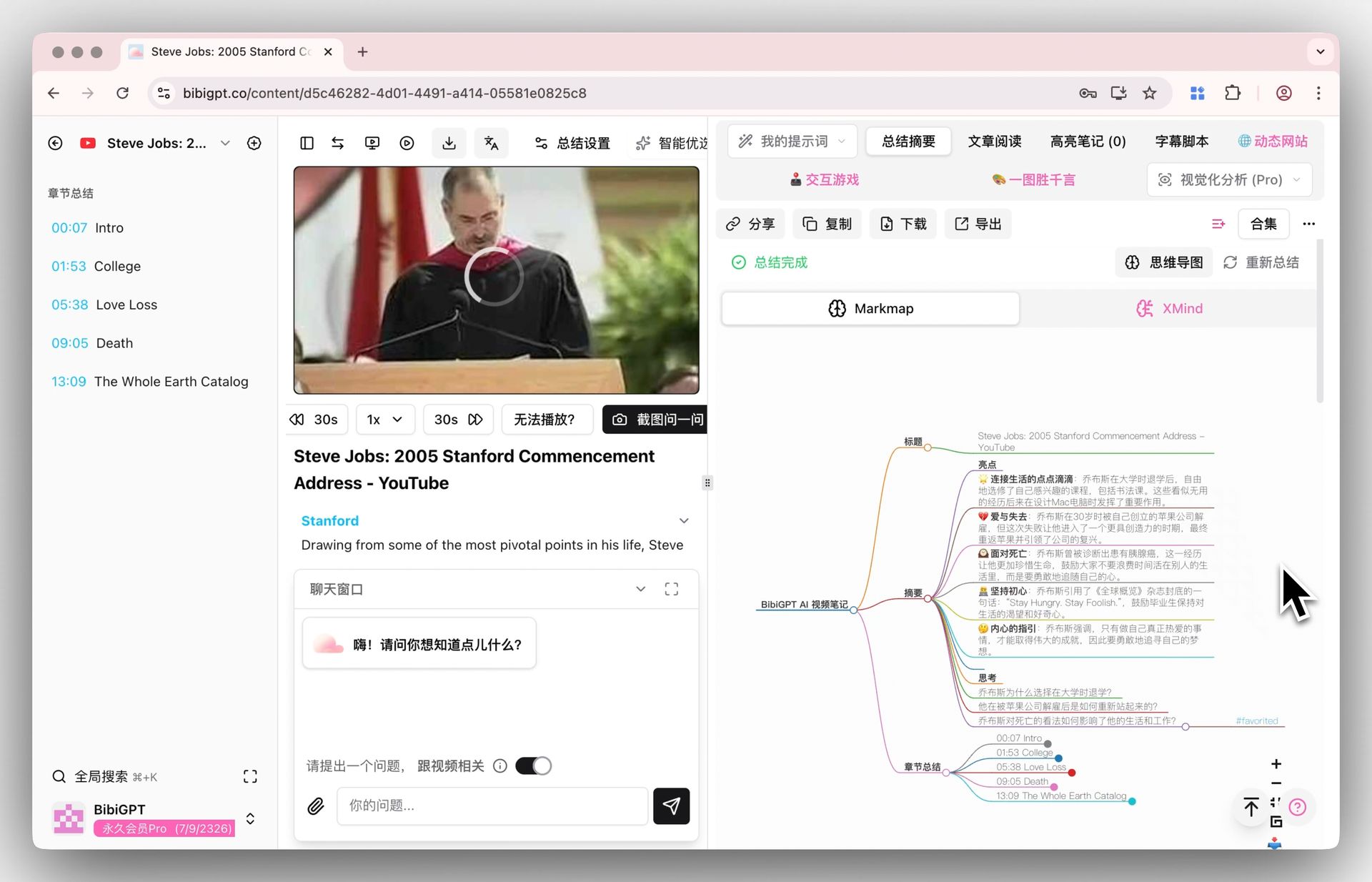

3단계: 심층 이해 — 마인드맵 + 출처 추적 Q&A

총요약 인라인 마인드맵: 텍스트 요약과 XMind/Markmap 뷰를 페이지를 벗어나지 않고 전환합니다.

BibiGPT 인라인 마인드맵 XMind 뷰

BibiGPT 인라인 마인드맵 XMind 뷰

AI 영상 대화 & 스마트 출처 추적: BibiGPT 채팅창에서 영상 내용에 대해 질문하면, 모든 답변에 클릭 가능한 타임스탬프가 붙어 원본 영상 클립으로 바로 이동합니다.

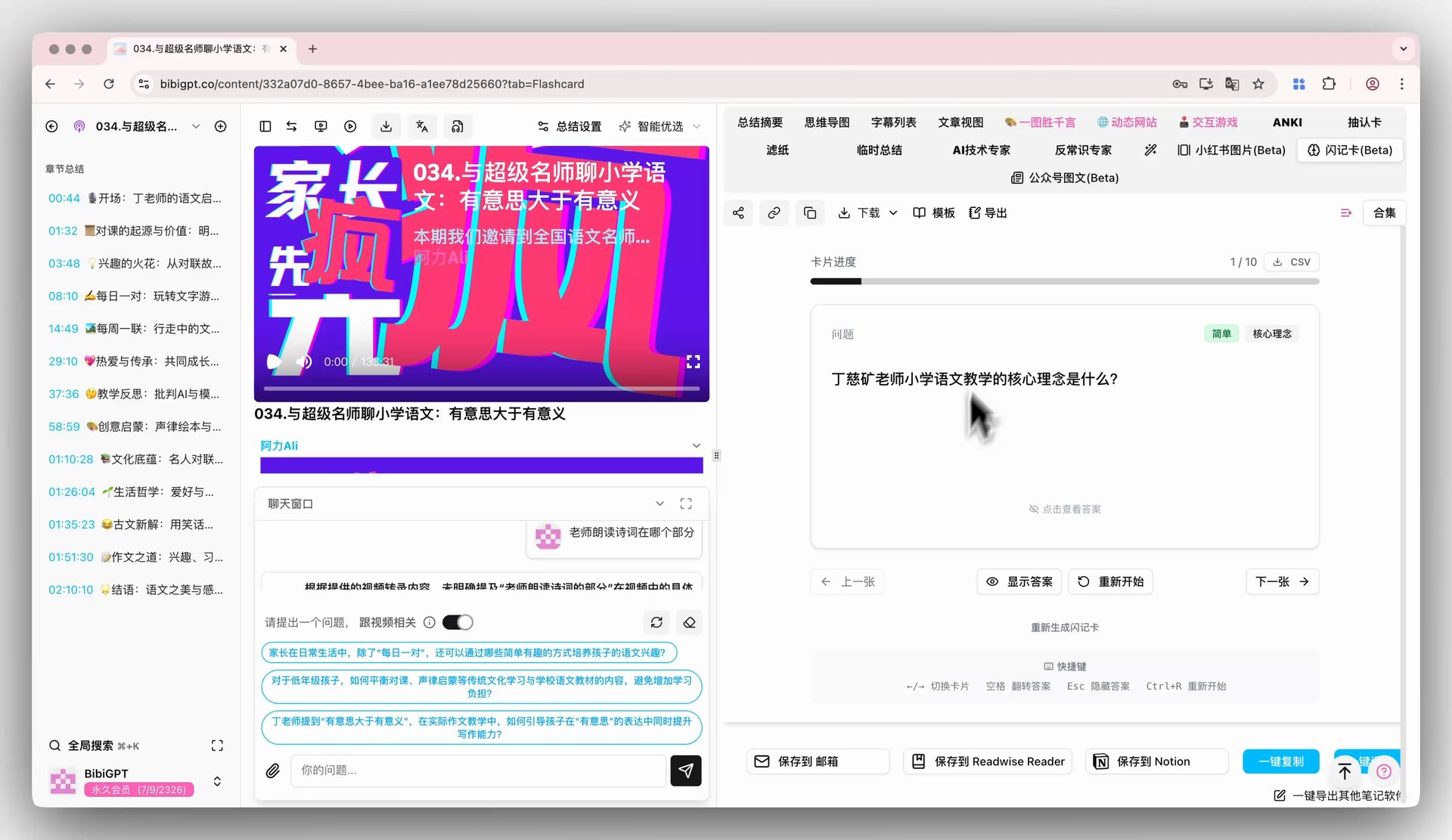

4단계: 능동적 복습 — 플래시카드 + Anki 간격 반복

BibiGPT의 플래시카드 기능이 영상 내용을 자동으로 Q&A 카드로 변환합니다:

BibiGPT 플래시카드: 영상에서 Anki 카드 자동 생성

BibiGPT 플래시카드: 영상에서 Anki 카드 자동 생성

- 영상 핵심 개념에서 Q&A 카드 자동 생성

- BibiGPT 내에서 인터랙티브하게 카드 복습

- CSV로 내보내 Anki에 가져오기 → 과학적 간격 반복

5단계: 지식 출력 — 이해를 공유 가능한 인사이트로

- 요약에서 핵심 구절 하이라이트 → 하이라이트 노트에 수집

- 공유용 이미지 카드 생성 (小红书 커버, X/트위터 카드 형식)

- Notion, Obsidian, Readwise로 내보내기

지금 바로 시작하세요

# BibiGPT 데스크탑 설치 (bibi CLI 포함)

brew install --cask jimmylv/bibigpt/bibigpt # macOS

# bibigpt-skill 설치

npx skills add JimmyLv/bibigpt-skill

# 인증 확인

bibi auth check

BibiGPT로 AI 에이전트 시대의 영상 학습을 시작하세요:

- 🌐 웹사이트: https://aitodo.co

- 💻 데스크탑 다운로드: https://aitodo.co/download/desktop

- ✨ 모든 기능 보기: https://aitodo.co/features

BibiGPT 팀