OpenAI Realtime API 정식 GA: MCP 도구 호출 + 환각 90% 감소 — BibiGPT가 오디오·비디오 라스트 마일을 연결하는 방법

OpenAI gpt-realtime API가 2025년 8월 28일 정식 GA로 출시되어 원격 MCP 서버 지원, 이미지 입력, SIP 전화 통합을 지원합니다. 세 가지 핵심 기능, 가격 변화, 전사 환각 90% 감소의 기술적 돌파, 그리고 MCP 도구로서 BibiGPT가 30개 이상 플랫폼의 오디오·비디오 콘텐츠를 30초 만에 요약하는 방법을 상세히 분석합니다.

OpenAI Realtime API 정식 GA: MCP 도구 호출 + 환각 90% 감소 — BibiGPT가 오디오·비디오 라스트 마일을 연결하는 방법

OpenAI gpt-realtime API가 2025년 8월 28일 정식 GA(General Availability)로 출시되었습니다. 음성 대 음성(speech-to-speech) 모델로서 세 가지 주요 기능이 추가되었습니다: 원격 MCP 서버 지원, 이미지 입력, SIP 전화 통합. Cedar와 Marin 두 가지 새로운 음성도 추가되었습니다. 동시에 전사 모델의 환각률이 Whisper v2 대비 약 90% 감소했습니다. 하지만 대부분의 사용자에게 Realtime API는 여전히 개발자 도구입니다 — 진입 장벽이 높고, 비용이 비싸며, 한국어 및 아시아 플랫폼 지원이 전무합니다. 100만 명 이상의 사용자를 보유한 전 플랫폼 AI 오디오·비디오 어시스턴트 BibiGPT가 최첨단 음성 AI와 일상적 오디오·비디오 소비 사이의 '라스트 마일'을 연결합니다.

OpenAI Realtime API 세 가지 돌파구: MCP, 이미지 입력, SIP 전화

Try pasting your video link

Supports YouTube, Bilibili, TikTok, Xiaohongshu and 30+ platforms

2025년 8월 28일, OpenAI는 gpt-realtime API의 beta에서 GA로의 전환을 발표했습니다(beta 버전은 2026년 5월 7일 지원 종료 예정). speech-to-speech 모델로서 AI가 '듣고' '말하는' 것이 핵심입니다 — 텍스트 변환 없이 직접 이해합니다. 다음은 세 가지 핵심 신기능입니다:

1. 원격 MCP 서버 지원

Realtime API가 이제 원격 MCP(Model Context Protocol) 서버 호출을 기본 지원합니다. 음성 에이전트가 대화 중 실시간으로 외부 도구를 호출할 수 있습니다 — 데이터베이스 조회, API 호출, 실시간 정보 획득 — 진정한 '말하면서 실행' 워크플로를 구현합니다.

2. 이미지 입력(Image Input)

gpt-realtime이 이제 멀티모달 입력을 지원합니다. 음성 대화 중 이미지를 전송하면 모델이 시각적 맥락과 음성 맥락을 결합하여 이해하고 응답합니다.

3. SIP 전화 통합

Twilio 및 Voximplant와의 통합을 통해 Realtime API가 기존 전화 네트워크에 직접 연결됩니다. 기업이 AI 전화 상담, 자동 아웃바운드 콜 시스템을 추가 음성 게이트웨이 없이 신속하게 구축할 수 있습니다.

성능 향상도 인상적입니다: S2S 모델이 벤치마크에서 26-48% 향상되었습니다(BigBench Audio 82.8%, MultChallenge 30.5%, ComplexFuncBench 66.5%).

가격 및 전사 품질: 개발자가 알아야 할 수치

핵심 답변: GA 버전은 preview보다 20% 저렴합니다. 오디오 입력 $32/백만 토큰, 출력 $64/백만 토큰, 캐시 입력 $0.40/백만 토큰(98.75% 절약). Mini 모델은 $10/$20입니다. 전사 모델의 환각률은 Whisper v2 대비 약 90% 감소했습니다.

| 모델 | 오디오 입력 | 오디오 출력 | 캐시 입력 |

|---|---|---|---|

| gpt-realtime | $32/1M tokens | $64/1M tokens | $0.40/1M tokens |

| gpt-realtime-mini | $10/1M tokens | $20/1M tokens | 더 낮음 |

캐시 입력의 98.75% 할인은 고빈도 호출 시나리오에 매우 매력적입니다.

전사 품질 측면에서 OpenAI의 새로운 전사 모델은 Whisper v2 대비 환각률을 약 90% 줄였습니다. 자막 생성, 회의록, 팟캐스트 텍스트 변환 등 전사 정확도에 의존하는 애플리케이션에 큰 호재입니다.

하지만 이것은 여전히 개발자 API 가격입니다. 일반 사용자는 Realtime API를 직접 사용할 수 없습니다.

일반 사용자에게 의미하는 것: 세 가지 현실적 격차

Realtime API는 분명 강력하지만, 오디오·비디오 소비자에게는 세 가지 현실적 격차가 존재합니다:

- 개발자 도구이지 소비자 제품이 아닙니다. Realtime API를 사용하려면 코드를 작성해야 합니다. UI도 없고 '링크를 붙여넣으면 바로 사용'하는 경험도 없습니다.

- 개인에게는 비용이 만만치 않습니다. GA 20% 할인 후에도 오디오 출력 $64/백만 토큰은 빠르게 누적됩니다.

- 비영어 플랫폼 지원이 전무합니다. Realtime API는 B站 동영상, 네이버 동영상, 틱톡 쇼츠를 요약하지 않습니다 — 이런 플랫폼의 존재를 모릅니다.

이것은 Realtime API에 대한 비판이 아닙니다. 원래 개발자 인프라로 설계된 것이기 때문입니다. 하지만 링크를 붙여넣기만 하면 사용할 수 있는 소비자 제품이 왜 필요한지를 정확히 보여줍니다.

플랫폼별 AI 요약에 대해 자세히 알아보세요: YouTube AI 요약, B站 AI 요약, 팟캐스트 AI 요약.

BibiGPT가 라스트 마일을 연결하는 방법: API에서 원클릭 요약까지

See BibiGPT's AI Summary in Action

Bilibili: GPT-4와 워크플로우 혁명

GPT-4가 업무 방식을 어떻게 혁신하는지 심층 분석한 과학 해설 영상. 모델 내부, 학습 단계, 사회적 변화를 다룹니다.

Want to summarize your own videos?

BibiGPT supports YouTube, Bilibili, TikTok and 30+ platforms with one-click AI summaries

Try BibiGPT Free핵심 답변: BibiGPT는 30개 이상의 오디오·비디오 플랫폼을 지원하고, 500만 건 이상의 AI 요약을 생성했으며, 최첨단 음성 AI와 일상적 오디오·비디오 소비를 연결하는 소비자 제품입니다. bibigpt-skill(MCP 도구)을 통해 음성 에이전트도 BibiGPT를 직접 호출하여 동영상 이해 능력을 얻을 수 있습니다.

레벨 1: 전 플랫폼 지원

Realtime API는 B站, 틱톡을 인식하지 못합니다. BibiGPT는 30개 이상의 플랫폼을 지원합니다 — YouTube, B站, 틱톡, 팟캐스트, 로컬 파일 — 링크를 붙여넣으면 AI 요약을 받습니다. 코드 작성 불필요.

레벨 2: 소비자급 경험

링크 붙여넣기부터 구조화된 요약 수령까지 30초. 마인드맵, 타임스탬프 추적 AI 대화, Anki 플래시카드 내보내기, 자막 번역 등 고급 기능을 제공합니다. 100만 명 이상의 사용자가 검증한 제품 경험입니다.

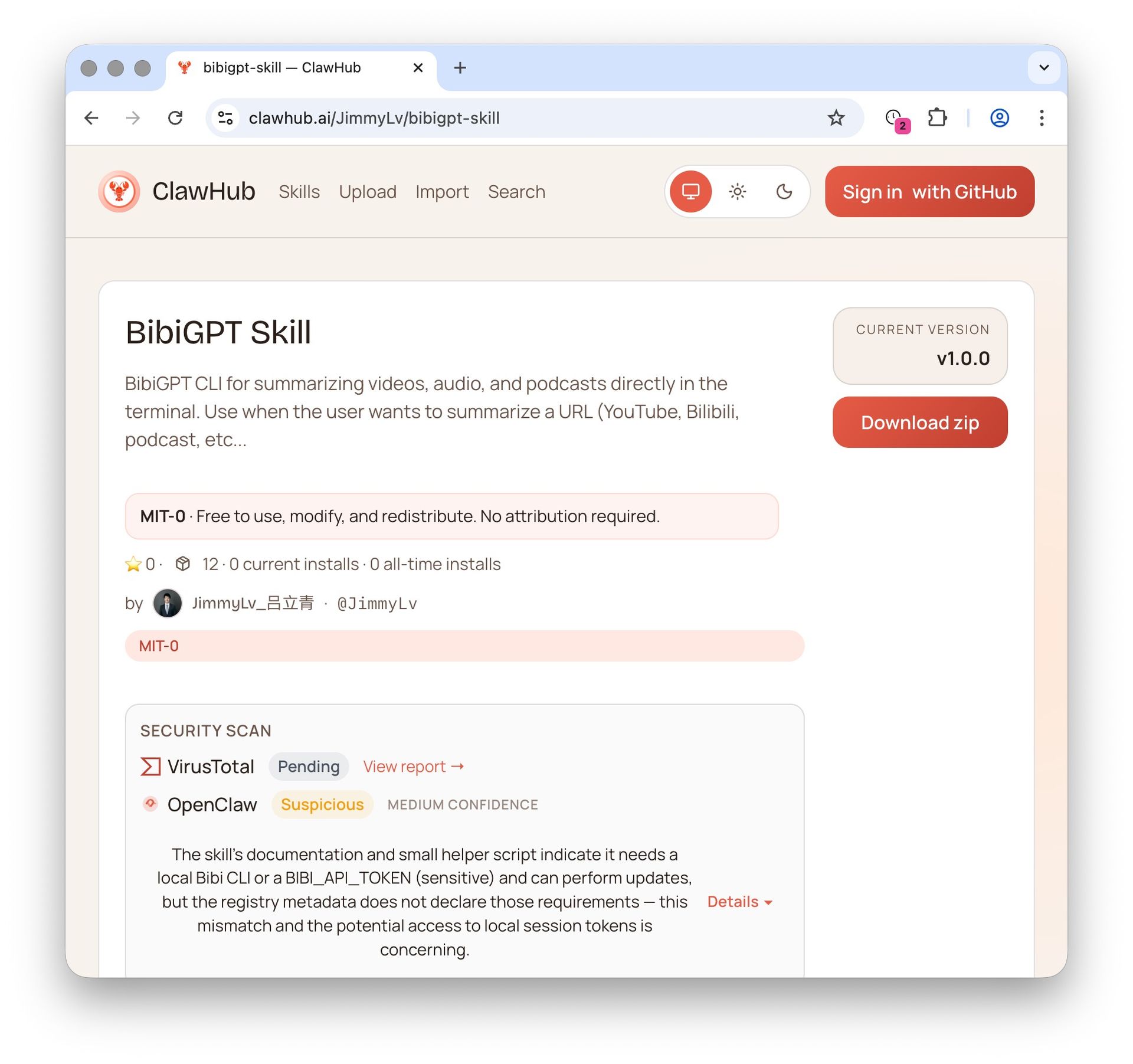

레벨 3: MCP 도구로서의 bibigpt-skill

Realtime API + MCP와의 가장 직접적인 연결입니다: BibiGPT 자체가 MCP 도구입니다. 음성 에이전트가 Realtime API의 MCP 기능을 갖추면 bibigpt-skill을 호출하여 BibiGPT의 동영상 요약 기능에 접근할 수 있습니다:

- 음성 에이전트에게 말합니다: "이 YouTube 동영상 요약해줘"

- 에이전트가 MCP를 통해 bibigpt-skill 호출

- BibiGPT가 구조화된 요약 반환

- 에이전트가 음성으로 요약을 읽어줌

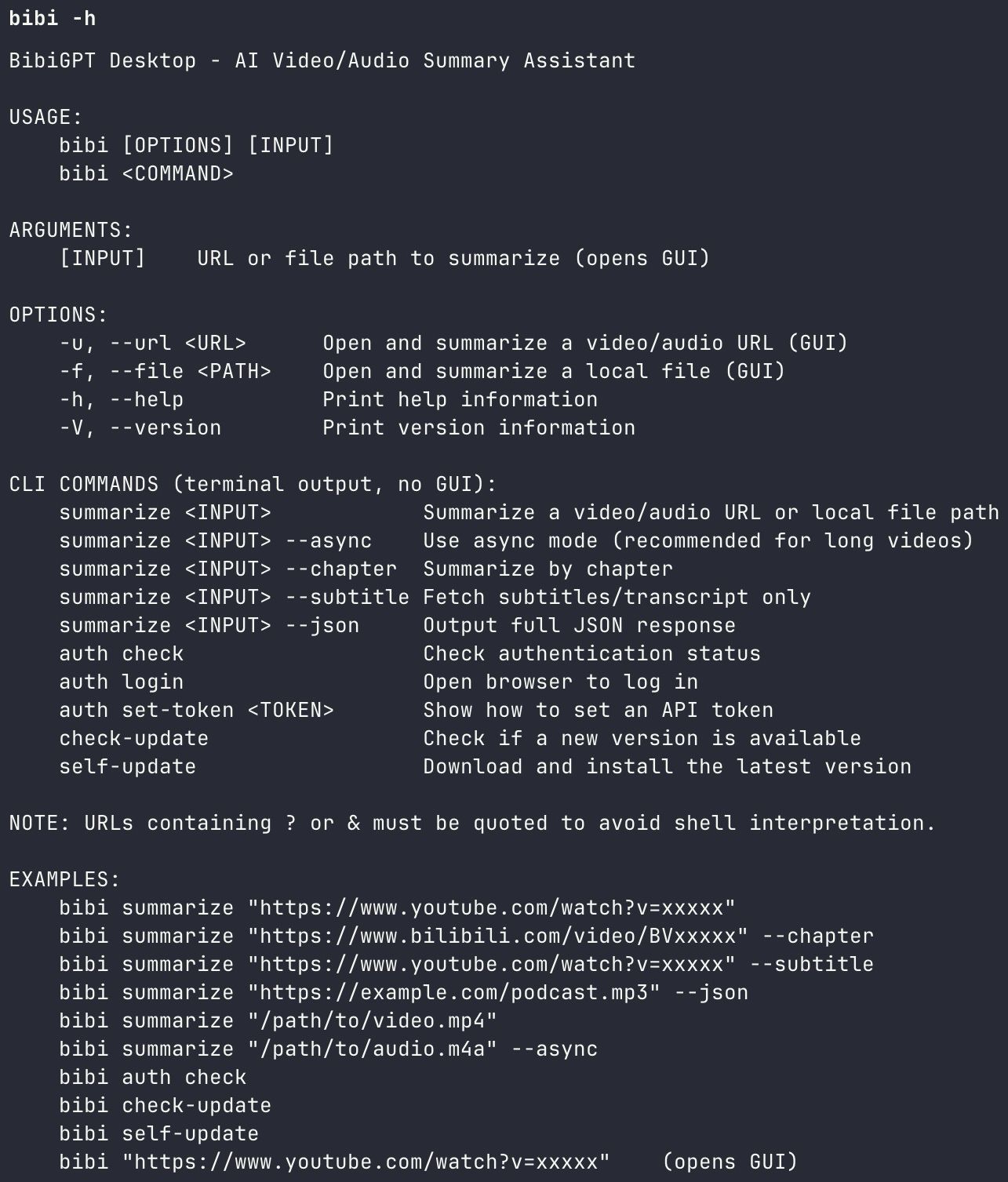

BibiGPT Agent Skill CLI

BibiGPT Agent Skill CLI

Realtime API의 음성 기능과 BibiGPT의 동영상 이해 기능이 원활하게 결합됩니다 — 전자는 '듣기와 말하기', 후자는 '동영상 보기'를 담당합니다. Agent Skill의 실제 활용법은 Claude Code + BibiGPT Agent Skill 가이드를 참고하세요.

BibiGPT on ClawHub

BibiGPT on ClawHub

실전 시나리오: Realtime API + BibiGPT 조합 활용

시나리오 1: 음성 기반 동영상 학습

운전 중 음성 어시스턴트에게 말합니다: "내 즐겨찾기에 있는 최신 AI 튜토리얼 동영상 3개를 요약해줘." 음성 에이전트가 MCP를 통해 bibigpt-skill로 일괄 처리하고, 핵심 내용을 음성으로 브리핑합니다. 화면을 보지 않아도 됩니다.

시나리오 2: 회의 녹음 + 참고 동영상 일괄 처리

Realtime API의 전사 기능(환각 90% 감소)으로 회의를 녹음 변환하고, bibigpt-skill이 회의 중 언급된 참고 동영상 링크를 동시에 처리합니다. 결과물: 회의록과 동영상 요약이 결합된 구조화된 보고서.

시나리오 3: 팟캐스트 크리에이터 효율 도구

팟캐스트 진행자가 SIP 전화 통합으로 원격 인터뷰를 녹음하고, Realtime API가 실시간으로 전사하며, BibiGPT의 팟캐스트 AI 요약 기능이 쇼노트와 타임라인을 자동 생성합니다. 후반 작업이 2시간에서 10분으로 단축됩니다.

Agent 워크플로에 대한 자세한 내용은 OpenClaw + BibiGPT Agent Skill 가이드를 참고하세요.

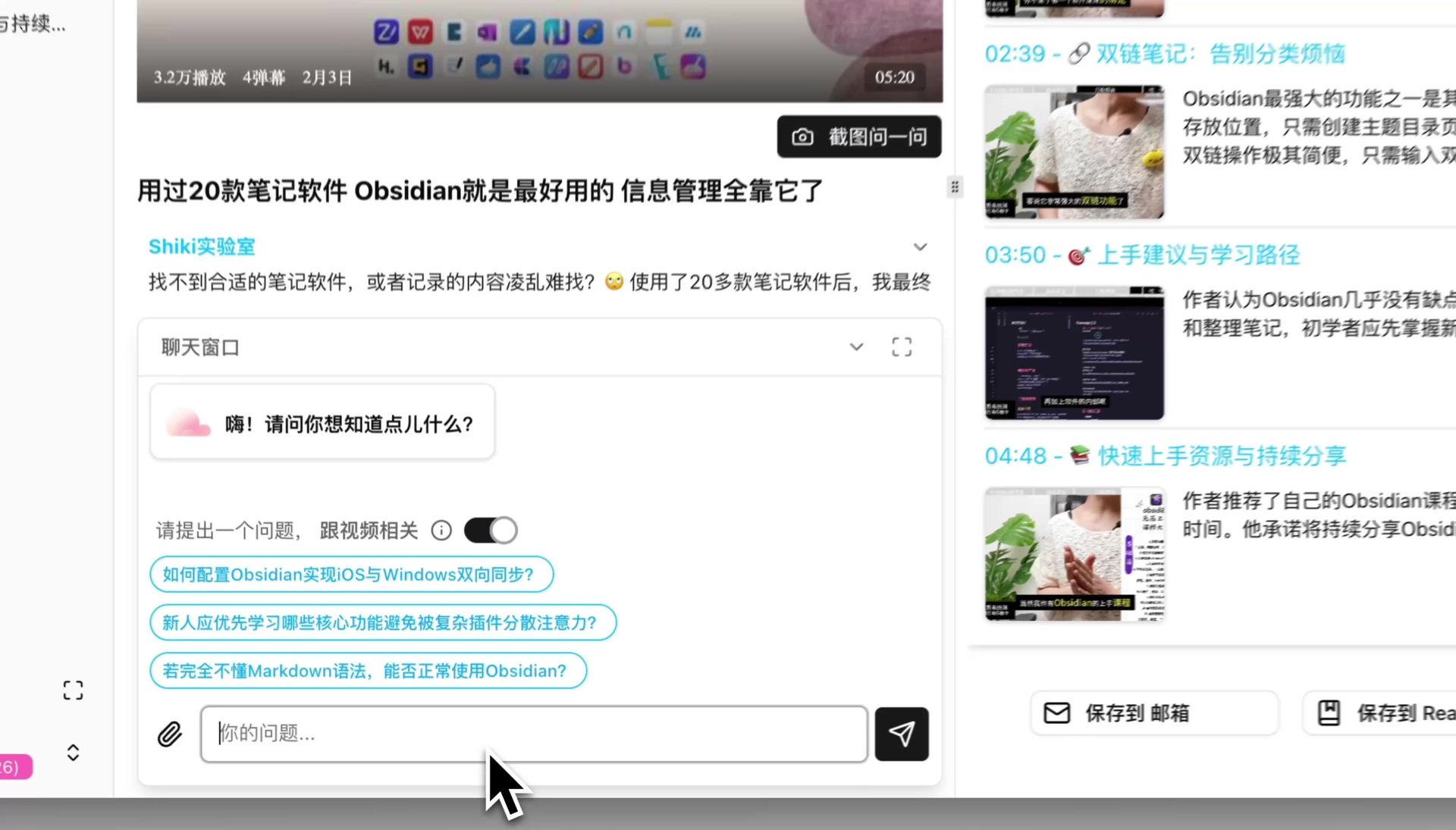

BibiGPT AI 대화

BibiGPT AI 대화

자주 묻는 질문 (FAQ)

OpenAI Realtime API와 ChatGPT 음성 기능의 차이점은 무엇인가요?

Realtime API는 음성 애플리케이션을 구축하기 위한 개발자 API로, speech-to-speech 모델입니다. ChatGPT의 음성 기능은 유사한 기술로 구축된 소비자 제품입니다. '엔진'과 '자동차'의 관계와 비슷합니다.

BibiGPT가 Realtime API를 사용할 예정인가요?

BibiGPT는 최신 AI 모델 기능을 지속적으로 평가하고 있습니다. Realtime API의 향상된 전사 품질(환각 90% 감소)과 MCP 도구 호출 기능 모두 BibiGPT 기술 스택에 통합될 후보입니다.

bibigpt-skill을 MCP 도구로 사용하면 추가 비용이 드나요?

bibigpt-skill은 BibiGPT 구독자(Plus/Pro)에게 제공되며, 일일 100회 Agent Skill 호출이 회원 혜택에 포함됩니다. MCP 관련 추가 비용은 없습니다.

Realtime API beta 버전은 언제 지원 종료되나요?

OpenAI는 2026년 5월 7일에 beta 버전 지원을 종료할 계획입니다. 현재 beta API를 사용 중인 개발자는 GA 버전으로 신속히 마이그레이션해야 합니다.

BibiGPT는 어떤 플랫폼의 오디오·비디오 요약을 지원하나요?

BibiGPT는 YouTube, B站, 틱톡, 팟캐스트(Apple Podcasts/Spotify), Twitter/X 동영상, 로컬 오디오·비디오 파일 등 30개 이상의 플랫폼을 지원합니다. 자세한 내용은 BibiGPT AI 오디오·비디오 요약 소개를 참고하세요.

마무리

OpenAI Realtime API의 GA 출시는 음성 AI 개발자 경험을 새로운 높이로 끌어올렸습니다. MCP 도구 호출, 멀티모달 입력, SIP 통합 — 각각이 음성 에이전트의 능력 경계를 확장합니다. 하지만 오디오·비디오 콘텐츠를 빠르게 소화해야 하는 대다수 사용자에게 필요한 것은 API가 아니라 링크를 붙여넣으면 바로 사용할 수 있는 제품입니다. BibiGPT는 30개 이상의 플랫폼, 500만 건 이상의 요약, MCP 도구 호출 기능으로 최첨단 AI를 일상 생산성으로 전환하는 다리 역할을 합니다.

지금 BibiGPT를 시작하세요:

- 웹사이트: https://aitodo.co

- 모바일 앱: https://aitodo.co/app

- 데스크톱 앱: https://aitodo.co/download/desktop

- 모든 기능: https://aitodo.co/features

BibiGPT 팀