OpenAI Realtime API 正式GA:MCPツール呼び出し + 幻覚90%削減 — BibiGPTが音声・動画のラストマイルを埋める方法

OpenAI gpt-realtime APIが2025年8月28日に正式GAとしてリリースされ、リモートMCPサーバーサポート、画像入力、SIP電話統合に対応しました。3つの新機能、料金変更、文字起こし幻覚90%削減の技術的ブレークスルー、そしてMCPツールとしてのBibiGPTが30以上のプラットフォームの音声・動画コンテンツを30秒で要約する方法を詳しく解説します。

OpenAI Realtime API 正式GA:MCPツール呼び出し + 幻覚90%削減 — BibiGPTが音声・動画のラストマイルを埋める方法

OpenAI gpt-realtime APIが2025年8月28日に正式GA(General Availability)としてリリースされました。speech-to-speech(音声対音声)モデルとして、3つの主要機能が追加されました:リモートMCPサーバーサポート、画像入力、SIP電話統合。CedarとMarinの2つの新しい音声も追加されています。また、文字起こしモデルの幻覚率がWhisper v2と比較して約90%削減されました。しかし、ほとんどのユーザーにとってRealtime APIは依然として開発者向けツールです — 参入障壁が高く、コストが高く、日本語プラットフォームのサポートはありません。 100万人以上のユーザーを持つ全プラットフォーム対応AI音声・動画アシスタントBibiGPTが、最先端の音声AIと日常の音声・動画消費の「ラストマイル」を繋ぎます。

OpenAI Realtime API 3つのブレークスルー:MCP、画像入力、SIP電話

Try pasting your video link

Supports YouTube, Bilibili, TikTok, Xiaohongshu and 30+ platforms

2025年8月28日、OpenAIはgpt-realtime APIのbetaからGAへの移行を発表しました(betaバージョンは2026年5月7日に廃止予定)。speech-to-speechモデルとして、AIが「聞いて」「話す」ことが核心です — テキスト変換なしで直接理解します。以下が3つの主要な新機能です:

1. リモートMCPサーバーサポート

Realtime APIがリモートMCP(Model Context Protocol)サーバーの呼び出しをネイティブサポートするようになりました。音声エージェントが会話中にリアルタイムで外部ツールを呼び出せます — データベースのクエリ、APIの呼び出し、リアルタイム情報の取得 — 真の「話しながら実行」ワークフローを実現します。

2. 画像入力(Image Input)

gpt-realtimeがマルチモーダル入力に対応しました。音声会話中に画像を送信すると、モデルが視覚コンテキストと音声コンテキストを組み合わせて理解・応答します。

3. SIP電話統合

TwilioおよびVoximplantとの統合により、Realtime APIが従来の電話ネットワークに直接接続できます。企業は追加の音声ゲートウェイなしに、AI電話サポートや自動発信システムを迅速に構築できます。

パフォーマンス向上も顕著です: S2Sモデルがベンチマークで26-48%向上しました(BigBench Audio 82.8%、MultChallenge 30.5%、ComplexFuncBench 66.5%)。

料金と文字起こし品質:開発者が知るべき数字

核心回答: GA版はpreviewより20%安くなりました。オーディオ入力$32/百万トークン、出力$64/百万トークン、キャッシュ入力$0.40/百万トークン(98.75%節約)。Miniモデルは$10/$20です。文字起こしモデルの幻覚率はWhisper v2比で約90%削減されています。

| モデル | オーディオ入力 | オーディオ出力 | キャッシュ入力 |

|---|---|---|---|

| gpt-realtime | $32/1M tokens | $64/1M tokens | $0.40/1M tokens |

| gpt-realtime-mini | $10/1M tokens | $20/1M tokens | より低価格 |

キャッシュ入力の98.75%割引は、高頻度呼び出しシナリオに非常に魅力的です。

文字起こし品質について、OpenAIの新しい文字起こしモデルはWhisper v2と比較して幻覚率を約90%削減しました。字幕生成、議事録、ポッドキャストのテキスト変換など、文字起こし精度に依存するアプリケーションにとって大きなメリットです。

ただし、これは依然として開発者API向けの料金です。一般ユーザーはRealtime APIを直接利用できません。

一般ユーザーにとっての意味:3つの現実的なギャップ

Realtime APIは確かに強力ですが、音声・動画コンテンツの消費者にとっては3つの現実的なギャップが存在します:

- 開発者ツールであり、消費者製品ではありません。 Realtime APIの利用にはコードの記述が必要です。UIも「リンクを貼るだけで使える」体験もありません。

- 個人には高コストです。 GA後の20%値下げ後もオーディオ出力$64/百万トークンは蓄積されます。

- 非英語プラットフォームのサポートがゼロです。 Realtime APIはBilibili動画やニコニコ動画を要約しません — これらのプラットフォームの存在を知りません。

これはRealtime APIへの批判ではなく、元々開発者インフラとして設計されたものです。しかし、リンクを貼るだけで使える消費者製品がなぜ必要かを明確に示しています。

プラットフォーム別AI要約について詳しくはこちら:YouTube AI要約、B站 AI要約、ポッドキャストAI要約。

BibiGPTがラストマイルを埋める方法:APIからワンクリック要約へ

See BibiGPT's AI Summary in Action

Bilibili: GPT-4ワークフロー革命

GPT-4がどのように仕事を変革するかを深掘りした科学解説動画。モデルの内部構造、学習段階、社会的影響を網羅。

Want to summarize your own videos?

BibiGPT supports YouTube, Bilibili, TikTok and 30+ platforms with one-click AI summaries

Try BibiGPT Free核心回答: BibiGPTは30以上の音声・動画プラットフォームをカバーし、500万件以上のAI要約を生成してきました。最先端の音声AI能力と日常の音声・動画消費を繋ぐ消費者製品です。bibigpt-skill(MCPツール)を通じて、音声エージェントもBibiGPTを直接呼び出して動画理解能力を得ることができます。

レベル1:全プラットフォーム対応

Realtime APIはBilibili、TikTokを認識しません。BibiGPTは30以上のプラットフォームに対応 — YouTube、Bilibili、TikTok、ポッドキャスト、ローカルファイル — リンクを貼り付けるだけでAI要約を取得できます。コード記述不要です。

レベル2:消費者グレードの体験

リンク貼り付けから構造化された要約の受信まで30秒。マインドマップ、タイムスタンプ追跡付きAI対話、Ankiフラッシュカードエクスポート、字幕翻訳などの高度な機能を提供します。100万人以上のユーザーが検証した製品体験です。

レベル3:MCPツールとしてのbibigpt-skill

Realtime API + MCPとの最も直接的な接点です:BibiGPT自体がMCPツールです。 音声エージェントがRealtime APIのMCP機能を持つと、bibigpt-skillを呼び出してBibiGPTの動画要約機能にアクセスできます:

- 音声エージェントに言います:「このYouTube動画を要約して」

- エージェントがMCPを通じてbibigpt-skillを呼び出し

- BibiGPTが構造化された要約を返却

- エージェントが音声で要約を読み上げ

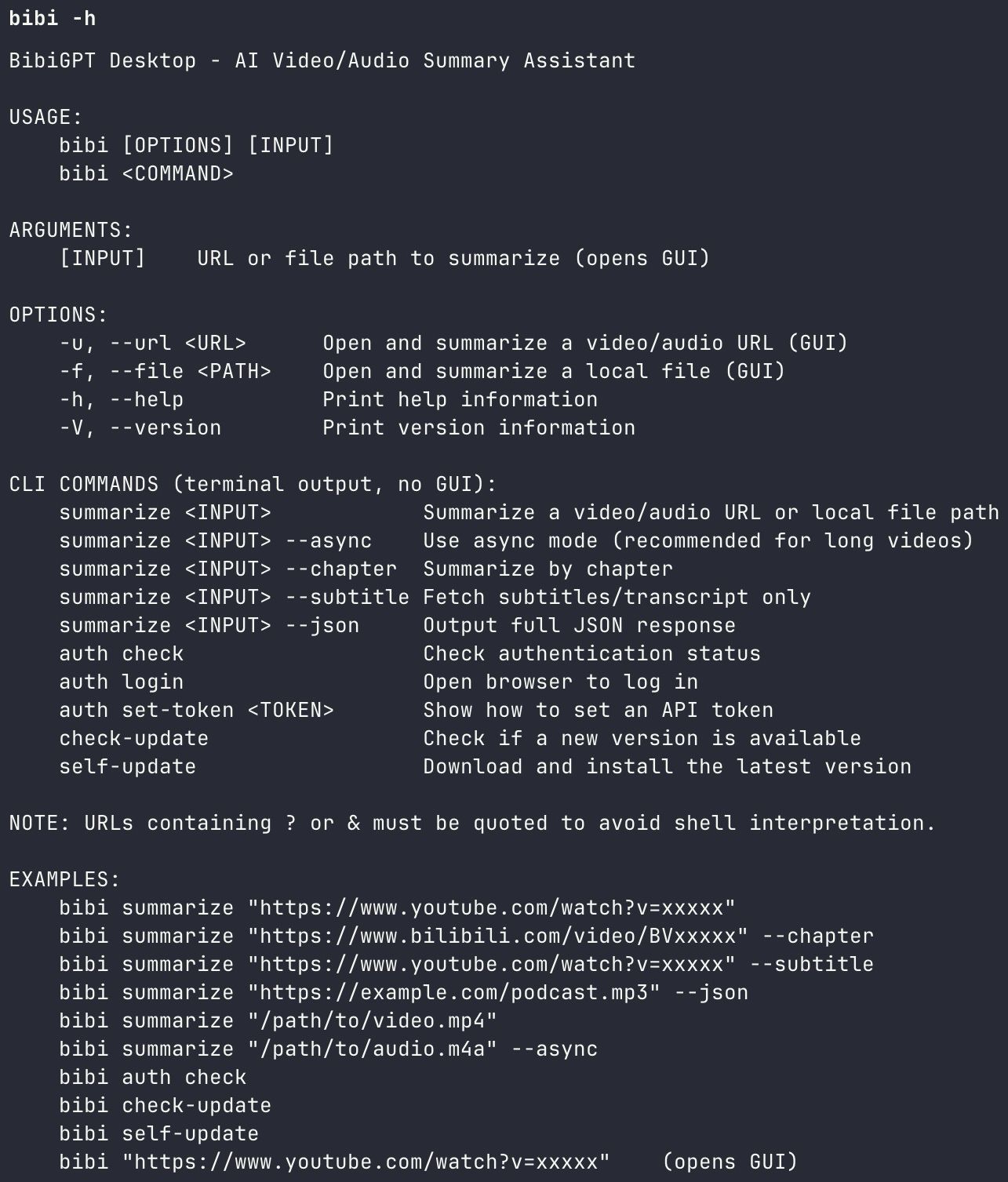

BibiGPT Agent Skill CLI

BibiGPT Agent Skill CLI

Realtime APIの音声機能とBibiGPTの動画理解機能がシームレスに組み合わさります — 前者が「聞くと話す」、後者が「動画を見る」を担当します。Agent Skillの実践的な使い方についてはClaude Code + BibiGPT Agent Skillガイドをご参照ください。

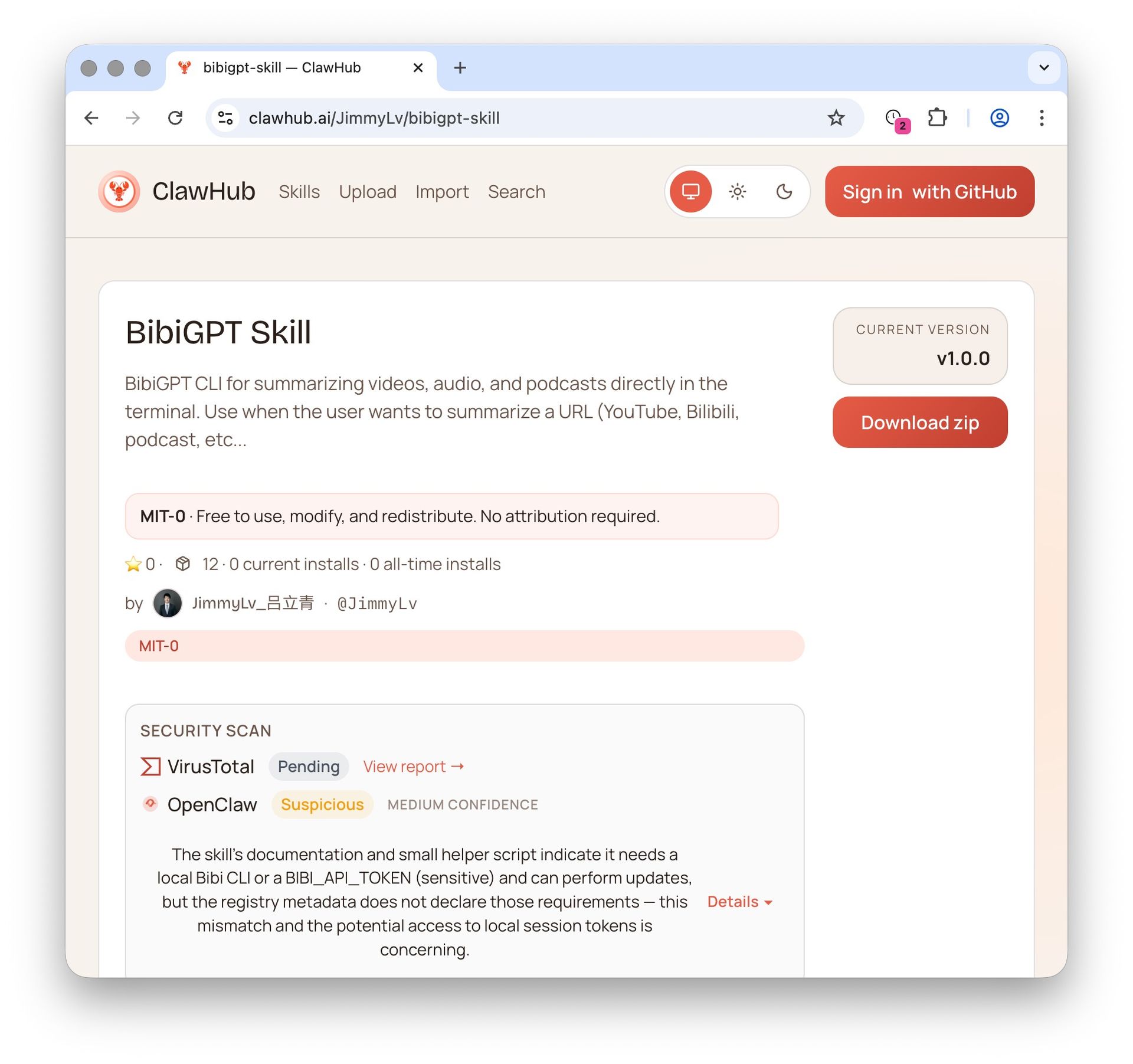

BibiGPT on ClawHub

BibiGPT on ClawHub

実践シナリオ:Realtime API + BibiGPTの組み合わせ活用

シナリオ1:音声駆動の動画学習

運転中に音声アシスタントに言います:「お気に入りの最新AI教程動画3本を要約して。」音声エージェントがMCPを通じてbibigpt-skillでバッチ処理し、各動画の核心ポイントを音声でブリーフィングします。画面を見る必要がありません。

シナリオ2:会議録音 + 参考動画の一括処理

Realtime APIの文字起こし機能(幻覚90%削減)で会議を録音変換し、bibigpt-skillが会議中に言及された参考動画リンクを同時に処理します。成果物:議事録と動画要約を統合した構造化レポート。

シナリオ3:ポッドキャストクリエイターの効率ツール

ポッドキャストホストがSIP電話統合でリモートインタビューを録音し、Realtime APIがリアルタイムで文字起こしし、BibiGPTのポッドキャストAI要約機能がショーノートとタイムラインを自動生成します。後処理が2時間から10分に短縮されます。

Agentワークフローの詳細はOpenClaw + BibiGPT Agent Skillガイドをご参照ください。

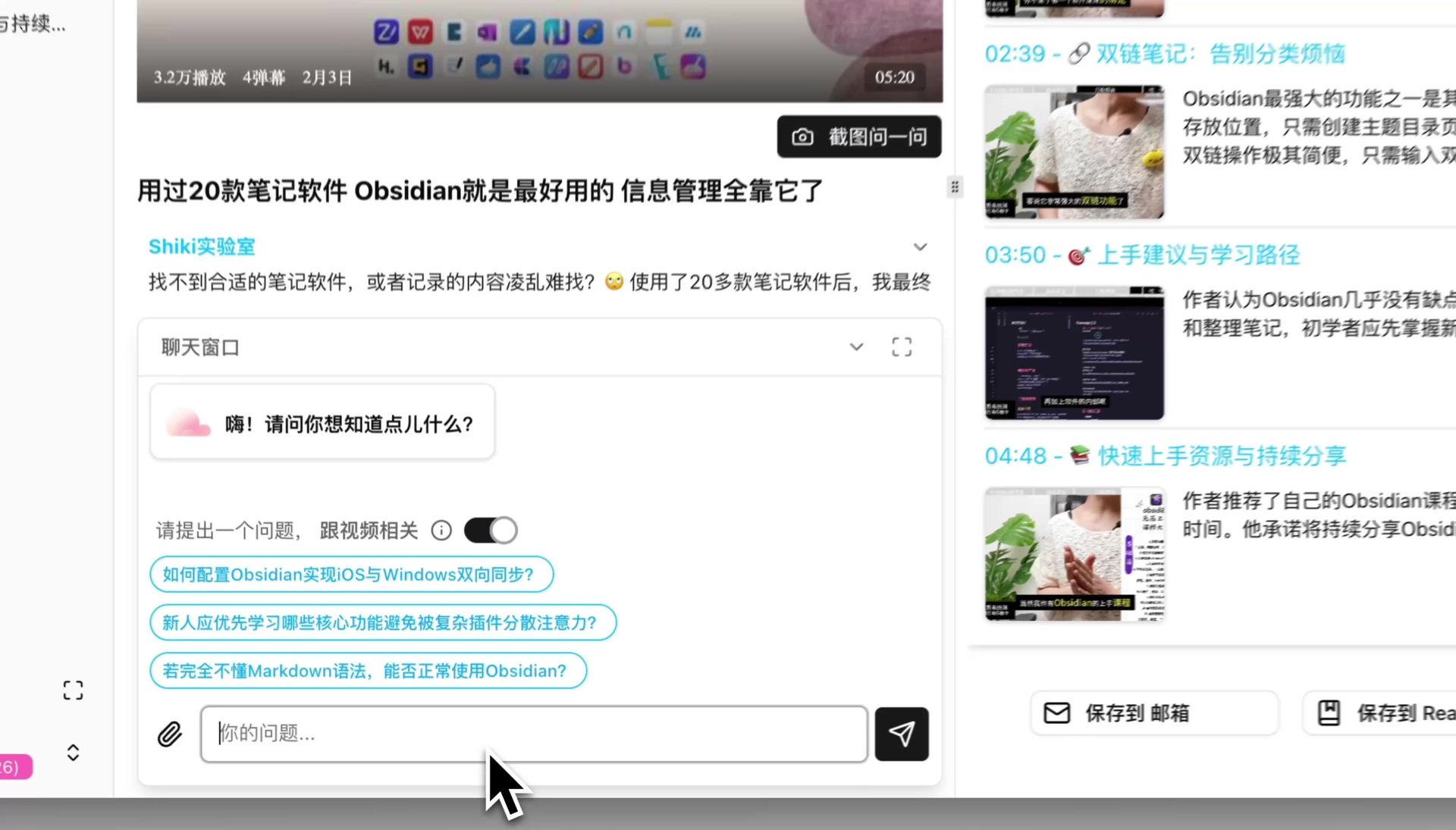

BibiGPT AI対話

BibiGPT AI対話

よくある質問(FAQ)

OpenAI Realtime APIとChatGPTの音声機能の違いは何ですか?

Realtime APIは音声アプリケーションを構築するための開発者APIで、speech-to-speechモデルです。ChatGPTの音声機能は同様の技術で構築された消費者製品です。「エンジン」と「自動車」の関係に似ています。

BibiGPTはRealtime APIを使用する予定ですか?

BibiGPTは最新のAIモデル機能を継続的に評価しています。Realtime APIの向上した文字起こし品質(幻覚90%削減)とMCPツール呼び出し機能は、どちらもBibiGPTの技術スタックへの統合候補です。

bibigpt-skillをMCPツールとして使用すると追加料金がかかりますか?

bibigpt-skillはBibiGPTサブスクリプション会員(Plus/Pro)に提供され、1日100回のAgent Skill呼び出しが会員特典に含まれています。MCP関連の追加料金は不要です。

Realtime APIのbetaバージョンはいつ廃止されますか?

OpenAIは2026年5月7日にbetaバージョンを廃止する予定です。現在beta APIを利用中の開発者は、GAバージョンへの早急な移行を推奨します。

BibiGPTはどのプラットフォームの音声・動画要約に対応していますか?

BibiGPTはYouTube、Bilibili、TikTok、ポッドキャスト(Apple Podcasts/Spotify)、Twitter/X動画、ローカル音声・動画ファイルなど30以上のプラットフォームに対応しています。詳細はBibiGPT AI音声・動画要約の紹介をご覧ください。

まとめ

OpenAI Realtime APIのGA公開は、音声AIの開発者体験を新たな高みに引き上げました。MCPツール呼び出し、マルチモーダル入力、SIP統合 — それぞれが音声エージェントの能力の境界を広げています。しかし、音声・動画コンテンツを素早く消化する必要がある大多数のユーザーに必要なのはAPIではなく、リンクを貼り付けるだけで使える製品です。BibiGPTは30以上のプラットフォーム、500万件以上の要約、MCPツール呼び出し機能で、最先端AIを日常の生産性に変換する架け橋です。

今すぐBibiGPTを始めましょう:

- ウェブサイト: https://aitodo.co

- モバイルアプリ: https://aitodo.co/app

- デスクトップアプリ: https://aitodo.co/download/desktop

- すべての機能: https://aitodo.co/features

BibiGPT チーム